摘要

在复杂的海空联合智能博弈环境下, 博弈环境态势信息高维且动态变化, 对实现异构作战单元协同决策提出了巨大挑战, 且当前现有算法多数存在维数爆炸, 泛化性差的问题. 因此, 如何通过有限的博弈环境态势信息, 实现异构作战单元协同决策, 是亟待解决的难题. 为此, 本文提出了能全面有效地表征博弈环境态势信息、指挥控制异构作战单元、引导算法训练方向的海空联合智能博弈问题的形式化建模方式. 其次, 提出了ASM2海空联合博弈算法, 该算法以MAPPO分布式多智能体博弈算法为基础, 设计了嵌入Elo评分系统的多对手多智能体训练框架, 提升了模型的泛化能力. 最后, 在兵棋推演仿真平台进行了验证测试, 结果表明所提算法训练后的模型能有效应对多种不同专家对手策略, 具有较好的可行性和泛化能力, 能够推动未来复杂无人装备作战对抗能力的提升.

Abstract

In the intricate air-sea joint intelligent game environment, the situational information of the game environment is high-dimensional and undergoes dynamic changes. This presents a significant challenge for achieving collaborative decision-making among heterogeneous combat units. Moreover, many of the existing algorithms grapple with issues of dimensionality explosion and suboptimal generalization. Addressing the challenge of facilitating collaborative decisionmaking through limited situational information becomes imperative. To tackle this, this paper introduces a formalized modeling approach for the air-sea joint intelligent game. This approach can holistically and effectively characterize the situational information, command and control heterogeneous combat units, and steer the algorithm training direction. Furthermore, we propose the ASM2 (air-sea multi-opponent multi-agent proximal policy optimization) algorithm for air-sea joint gaming. Rooted in the multi-agent proximal policy optimization (MAPPO) distributed multi-agent gaming algorithm, ASM2 incorporates a multi-opponent multi-agent training framework embedded with the Elo scoring system, enhancing the model’s generalization capabilities. Validation tests on a wargame simulation platform indicate that the model, once trained with our proposed algorithm, can adeptly handle various expert opponent strategies. It showcases commendable feasibility and generalization prowess, paving the way for bolstering the combat capabilities of future complex unmanned equipment.

1 引言

随着科技的发展和战争节奏的加快,现代战争的复杂程度不断提高,单纯依赖人脑决策已难以跟上博弈环境态势的更迭变化. 随着智能战争时代的到来,未来战争急需快速、智能化的决策方式,以应对高速且复杂多变的博弈环境,提高决策的准确性. 兵棋推演,特别是实时策略类兵棋推演,通过计算机仿真技术,对现实世界博弈问题进行模拟,随着模拟保真度日益增长,已能够支撑不对称不完全信息下的动态博弈,辅助训练指挥员的作战能力,是研究作战编组对抗战术的重要工具.

对于智能博弈问题,现有研究多数存在局限性,例如微分对策法计算量大难以收敛,影响图法难以保证在线实时性,专家系统法具有适应性较差等问题,无法形成快速准确的决策方案. 而深度强化学习方法兼具深度神经网络和强化学习方法的优点,具有超强的表示能力和较高的决策能力,在每一个时间步根据探测状态得到最佳动作,从而形成一条最优决策序列,最终得到具有较高博弈水平的智能体模型.

本文从深度强化学习和博弈论入手,进行海空联合智能博弈技术研究,提出了多智能体海空联合博弈(air-sea multi-opponent multi-agent proximal policy optimization,ASM2)算法,充分利用对阵多个对手收集的数据、知识和规则,建立和优化决策模型. 此研究能够为设计作战方案和战术分析提供数据支撑,控制作战单元进行对抗或辅助专家进行决策,为我国智能化作战进程提供助力,具有一定的理论价值和实践意义.

2 研究现状

针对智能博弈对抗问题,目前的研究根据其核心方法不同,主要分为基于博弈理论的方法 [1-3]、基于优化理论的方法 [4-5]、基于规则系统的方法 [6-9] 和基于深度强化学习的方法 [10-16] .

基于博弈理论的方法主要包括微分对策法和影响图法. 微分对策法将博弈对抗转换成双边极值问题进行求解,傅莉等 [1] 在微分对策法中引入机器博弈中的变值思想,改进了传统空战中以角度作为支付函数的微分对策模型,使无人机的空战策略更加合理; Park 等 [2] 提出基于博弈双方信息构建了描述作战优势的分数矩阵,并结合微分博弈形成了分层机动决策. 影响图是一种有向无环图,是一种表示求解不确定性问题的方法,可以有效利用人类专家知识进行智能决策结构建模,周思羽等 [3] 将随机决策理论和影响图法结合,解决了态势评估难以确定先验似然函数的问题. 但是,基于博弈论的方法难以对智能博弈对抗问题进行建模,且容易带来维数爆炸的问题.

基于优化理论的方法主要包括统计学优化、贝叶斯推理、动态规划等方法. Mcgrew [4] 提出了用近似动态规划寻优算法解决智能博弈对抗问题,用连续函数逼近器近似表示累计奖励; 杨璐等 [5] 设计了基于贝叶斯推理和分层思想的空中目标意图识别方法,把握博弈环境态势,提高了博弈对抗水平. 但是,基于优化理论的方法对计算性能要求较高,难以满足实时性的要求.

基于规则系统的方法一般采用谓词逻辑设计产生式规则,侧重于动作的选择和寻优,但该类方法存在明显的上限,缺乏多样性. 董倩等 [6] 构建了基于模型外部自主决策的博弈对抗行为树模型,有效实现自主决策; 张可等 [7] 提出了关键点推理遗传模糊系统框架,整合兵棋专家规则库和兵棋复盘数据库进行学习,并建立了反馈机制,有效提高推理的准确性; 刘满等 [8] 针对群队级博弈对抗问题,提出了战术级兵棋实体行动智能决策模型框架,通过数据挖掘和多属性综合评价软优选算法决策出作战单元的行动,后续刘满等 [9] 又提出了专家知识与数据互补的决策算法,采用分组决策、位置评估指标并行计算等方式,实现了作战单元的灵活决策.

基于深度强化学习的方法是目前使用最广泛的方法,该方法将智能博弈对抗问题形式化成马尔科夫决策过程问题,设计算法最小化损失函数,更新并修正智能体的行为. Piao等 [10] 提出多智能体分层策略梯度方法,用自博弈对抗学习出博弈策略; 杨爱武等 [11] 用动态贝叶斯网络,通过对敌我方概率分布的预测,判定我方采取的动作; 张大永等 [12] 提出了综合智能预测算法,构建马尔可夫决策过程(Markov decision process,MDP)与长短期记忆网络(long short-term memory,LSTM)双层神经网络模型,通过关键征候信息序列预测对手任务,加强态势认知能力; 施伟等 [13] 提出基于深度强化学习的多机协同决策流程框架,并针对近端策略优化算法(proximal policy optimization,PPO)设置了优先采样、经验探索、嵌入式专家经验奖励等机制; 魏竞毅等 [14] 提出了一种基于互信息的Option分层强化学习算法互信息异步优势演员评论家算法(mutual information asynchronous advantage actor-critic,MI-A3C),使智能体能发现更多具有长远收益的策略; 徐志雄等 [15-16] 将元学习应用于深度强化学习方法中,利用不同决策轨迹提炼元知识,建立学习元知识的分层网络架构,提升策略模型快速适应多任务的能力,并根据指挥员对不同历史轨迹数据的评价,确定网络参数梯度更新方向,缩短了策略模型训练时长,缓解了初始策略模型冷启动问题.

综上,基于博弈理论的方法难以对大规模智能博弈对抗问题进行建模,当博弈局中个体数量逐渐增多时,基于博弈论的方法将面临建模困难,维数爆炸等挑战,故而难以找到使每个个体都达到期望收益最大值的策略,难以求得纳什均衡的解析解. 由于智能博弈对抗问题状态空间的复杂性,基于优化理论的方法在求解高维大规模问题时,对计算机算力性能要求较高,算法难以在短时间内求出结果,无法满足决策实时性的要求. 基于规则系统的方法需依赖人类专家完成,而且存在明显的认知上限. 基于深度强化学习的方法会存在非完全信息下态势表示、决策空间巨大、奖励设置稀疏、模型泛化性差等问题,因此,本文结合深度强化学习和博弈论的方法,进行海空联合智能博弈技术研究. 本文的贡献如下:

1)针对博弈环境态势复杂多变的问题,设计了基于全局信息的智能博弈形式化建模方式,结合各方兵力与博弈环境全局态势状况,表征了博弈环境中的多元信息,使算法能在宏观层面上对整个战场的态势进行全面的把控,从而提高系统的决策质量;

2)针对海空联合异构作战单元博弈问题,提出了 ASM2海空联合博弈算法,为各类单元设计了不同的状态、动作和奖励,实现异构作战单元协同决策. 这种有针对性的设计在博弈中能充分发挥各类型作战单元的优势,从而提高整体的博弈水平;

3)针对现有算法在对手策略动态变化时泛化性差的问题,设计了嵌入埃洛评分系统(Elo rating system)[17] 的多对手多智能体海空联合训练框架,选择对手时,将所有对手的Elo分数归一化,作为选择对手的概率,在训练过程中能够优先选择博弈水平较高的对手,提高采样的质量和效率及模型的泛化能力.

3 问题构建与形式化

3.1 问题描述与构建

在一般的智能博弈系统中,每方都是由多个智能体单元构成的,且对手信息和对手策略不能完全可知,具有较大的不确定性. 本文采用的多智能体强化学习方法具备协调性、推理能力和自组织能力,让多个智能体与环境进行交互来获取学习样本,能有效解决多智能体智能博弈问题. 对于不确定性多智能体强化学习,通常采用分布式部分可观的马尔科夫决策过程(decentralized partially observable markov decision process,Dec-POMDP)进行决策过程建模,其中每个单智能体根据自身局部观测信息独立地选择动作,并最大化全局目标值.

Dec-POMDP 模型由九元组 {I,S,A,P,R,Ω, O,n,γ}定义 [18],其中: I表示多个智能体的集合; n表示智能体的个数; 在每个时间步,S为全局状态空间,智能体i通过观测函数O获取当前智能体的局部观测oi, Ω为局部观测的集合,即oi = O(s,i)∈ Ω; 随后,智能体i根据获取的局部观测执行可用动作ai ∈ A; 联合动作a ∈ A形成后,智能体与环境交互,获取联合奖励R(s,a),并以状态转移概率P(s′|s,a)进行状态转移; γ表示折扣因子. 对于海空联合智能博弈问题,将每个作战单元视为智能体,并对博弈问题进行形式化表示,方可将强化学习方法应用于该问题中.

3.2 智能博弈问题的形式化表示

针对海空联合智能博弈问题,本节提出了能全面表征博弈环境态势信息,辅助智能体行动的形式化方式. 海空联合智能博弈问题通常涵盖飞机F、舰船V、潜艇U等不同类型的智能体单元,以下将从状态特征表示、智能体动作设计、回报函数设置三方面对问题形式化展开论述.

3.2.1 状态空间表示

状态空间包含全局状态和局部观测两部分: 全局状态用于评估并更新智能体策略,局部观测用于计算智能体执行动作的概率. 全局状态S为所有飞机智能体局部观测fi、舰船智能体局部观测vi、潜艇智能体局部观测ui的集合,定义n1,n2,n3为飞机、舰船和潜艇智能体的数量,可得

(1)

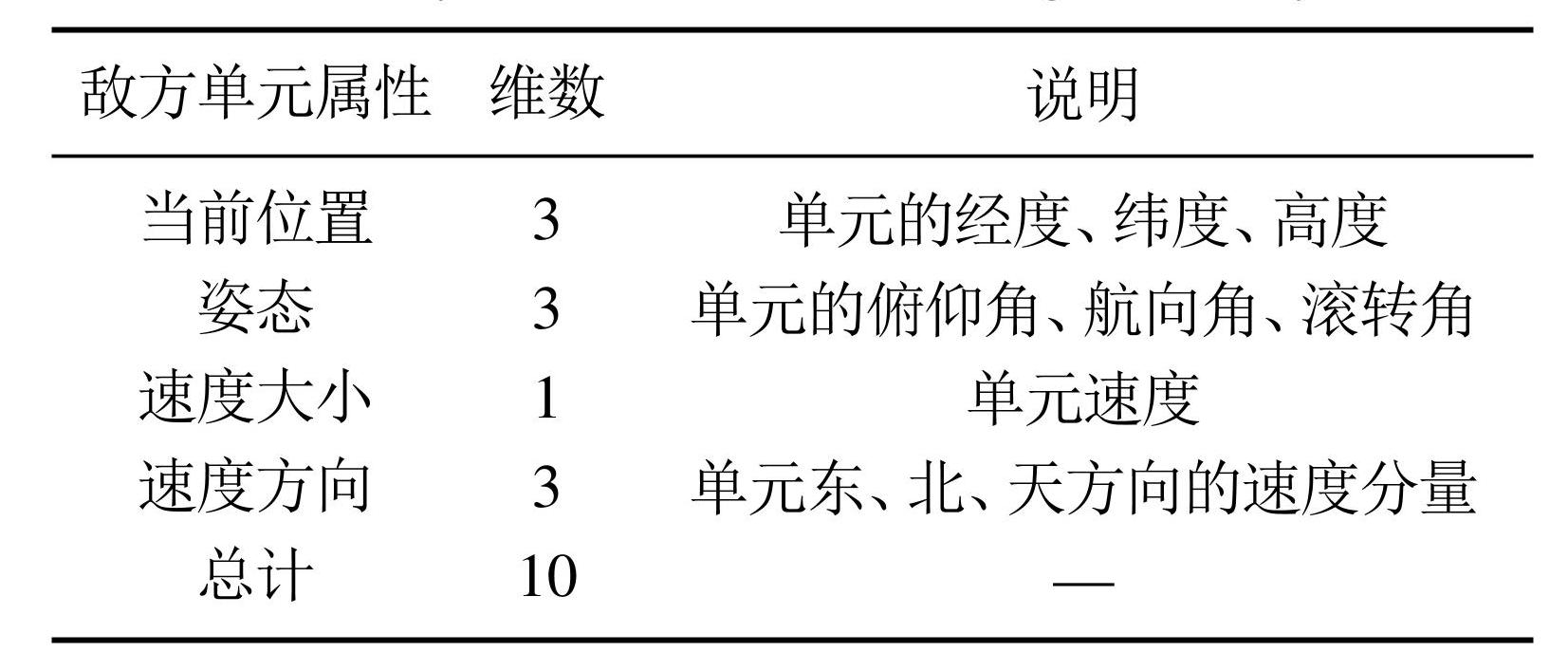

智能体i的局部观测oi为当前单元M、友方单元 T、敌方单元E实体信息的集合. 对于当前单元、友方单元和敌方单元,单个实体信息详情如表1–2所示.

表1单个当前单元M或友方单元T的实体信息

Table1Entity information of a single current unit M or friendly unit T

表2单个敌方单元E的实体信息

Table2Entity information of a single enemy unit E

根据智能体单元类型,整合当前单元M、友方单元T、敌方单元E的多条实体信息,作为当前智能体的局部观测oi . 由于附近的单元与我方当前智能体的行为相关性较大,会对智能体决策造成影响,而其他过远的智能体影响较小,因此统计离当前单元M最近的 3个友方单元T和敌方单元E的实体信息. 各类智能体局部观测oi详细信息如表3所示,统计敌我方多种作战单元的信息,可以从多角度表征博弈环境态势状况,充分发挥各作战单元的优势.

表3智能体局部观测oi

Table3Agent local observation oi

根据上述方案,对于飞机F、舰船V 和潜艇U智能体,分别整合当前单元M、友方单元T、敌方单元E的实体信息作为智能体局部观测oi; 再将所有飞机智能体F的局部观测fi、舰船智能体V 的局部观测vi和潜艇智能体U的局部观测ui整合作为全局状态S. 这种全局状态S和局部观测oi相结合的状态空间表示形式能从多层次、宽维度提取博弈环境的态势信息和多种作战单元的数据信息,有助于训练多智能体协同策略.

3.2.2 动作空间表示

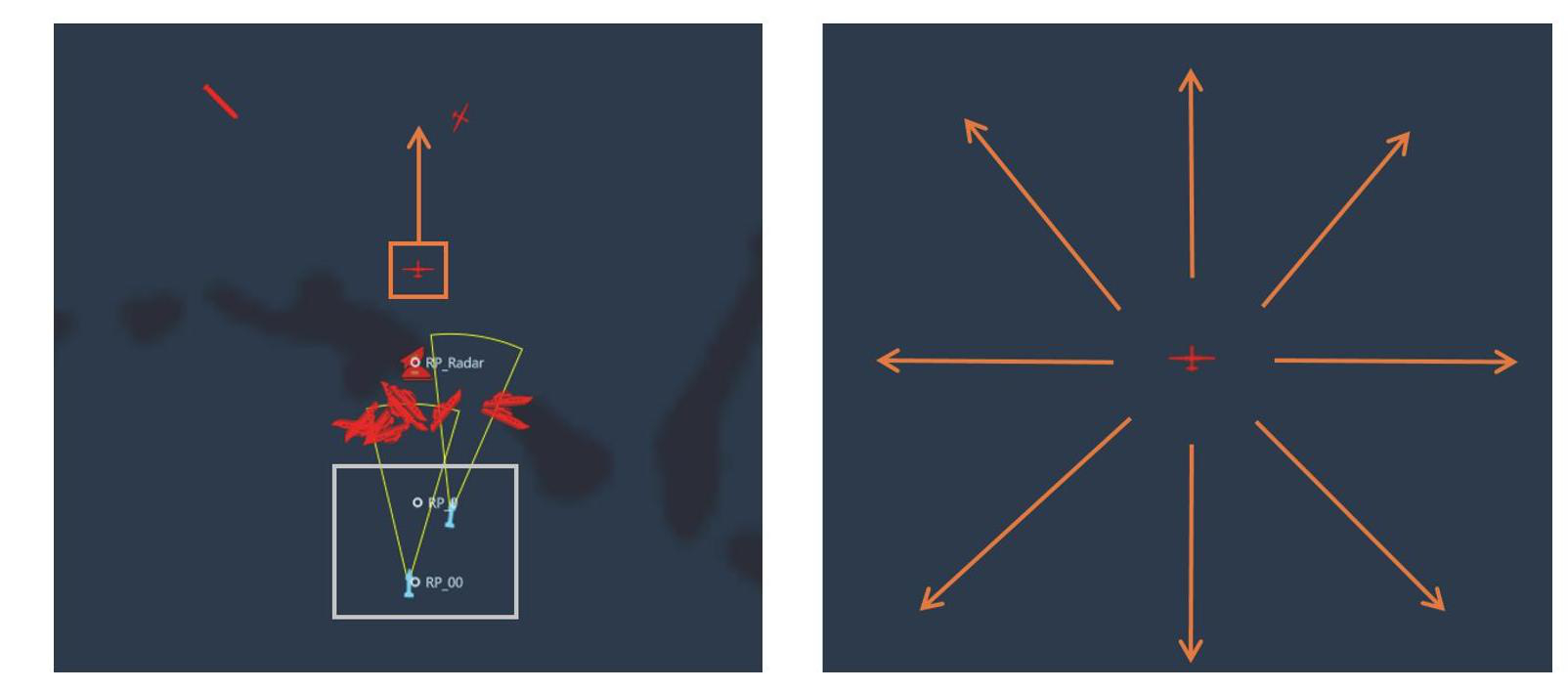

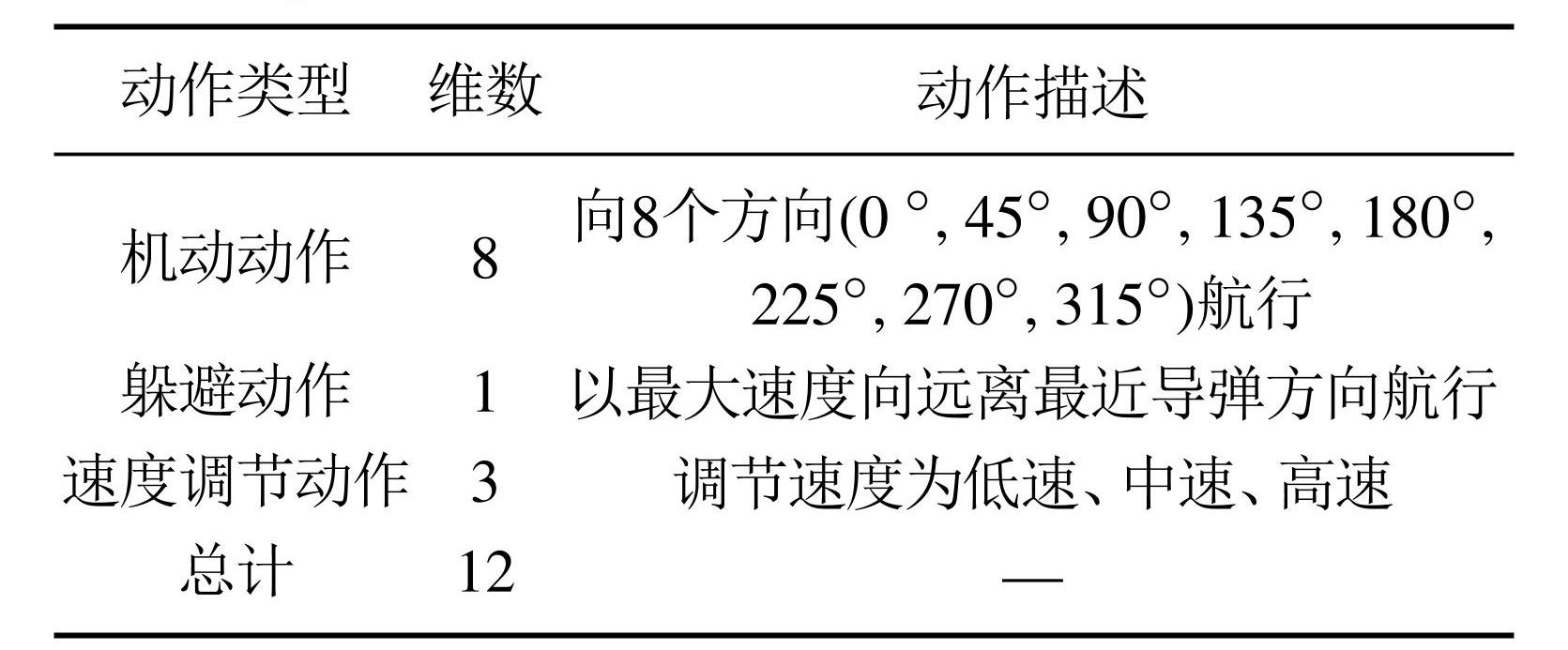

在涵盖多种作战单元的情形下,为增强各类作战单元的机动性和灵活性,提高智能体的操作上限,针对飞机F、舰船V 和潜艇U智能体,设计异构多智能体离散动作空间. 对于飞机智能体F,动作空间包含机动、躲避、速度调节、高度调节共15维动作; 对于舰船智能体V 和潜艇智能体U,动作空间包含机动、躲避、速度调节共12维动作. 其中机动、躲避动作如图1所示,各作战单元动作空间设计如表4–5所示.

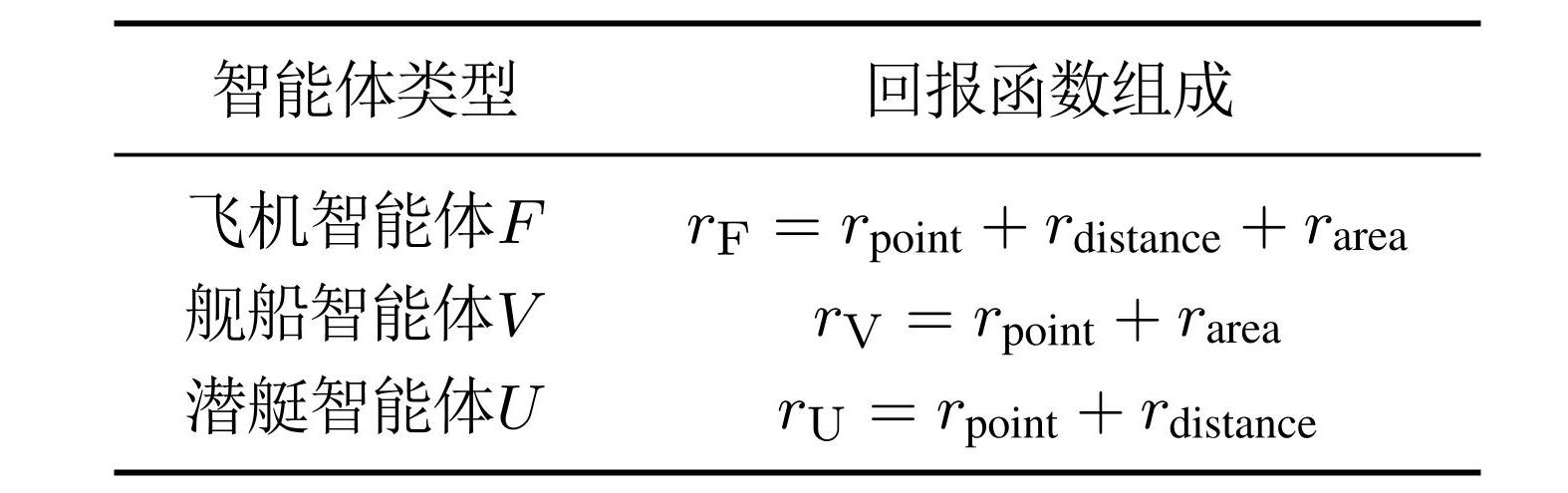

3.2.3 回报函数设置

对于强化学习算法,回报承担了指引训练方向的作用,在训练过程中,优秀的瞬时回报函数可大幅提高训练的速度,降低训练难度. 若回报设置稀疏,算法效率和收敛性会受到一定的影响,在博弈对抗场景下,若仅考虑胜负信息,则在推演结束才能获得回报,且难以判断对抗过程中作战单元的何种动作是有效的. 因此,本文设计稠密立即回报,加入局中回报信息,缓解回报稀疏问题,同时避免加入的信息误导智能体行为,导致训练偏离正确方向. 根据对局信息类型,设计了战损回报rpoint、距离回报rdistance和区域回报rarea.

图1躲避、机动动作

Fig.1Dodge and maneuver action

表4飞机智能体F动作空间

Table4Fighter agent F action space

表5舰船智能体V 、潜艇智能体U动作空间

Table5Action space of vessel agent V and submarine agent U

战损回报rpoint: 根据各类作战单元重要性,为其赋予分值. 计算相邻时间步分值差,归一化后作为该单元战损回报,并在最后回传最终分值作为幕回报.

距离回报rdistance: 为指引智能体向主要博弈区域行进,在区域中设定一个目标点,计算相邻时间步当前单元与目标点之间的距离差,归一化得到距离回报. 朝着目标点方向前进,距离回报为正,反之为负.

区域回报rarea: 在博弈环境中划定区域,智能体在区域中赋予较小奖励,根据区域重要性调整奖励大小; 离开区域赋予较小惩罚,引导单元在区域内移动. 通过区域回报,限制智能体的活动区域.

根据智能体类型,对上述3种稠密回报进行组合,设计回报函数如表6所示.

表6智能体回报函数

Table6Agent reward function

在对局的前期,给予距离奖励和区域奖励较高的权重,以鼓励智能体单元更积极地向战场区域前进; 随着对局的深入,特别是对局的后期,逐渐提高战损奖励的权重并相应地降低距离奖励和区域奖励的权重,让智能体在关键的对抗时刻更加注重战损,而不是单纯地追求空间因素产生的奖励. 以飞机智能体F 为例,动态调整权重后回报函数为

(2)

其中: α和β是调整速率,t表示当前推演的时间.

4 ASM2海空联合博弈算法设计

对于海空联合智能博弈问题,本文采用多智能体强化学习算法,每个智能体根据自身部分可观的局部观测信息来行动,并最大化全局目标值. 本文设计的 ASM2海空联合博弈算法基于多智体近端策略优化算法(multi-agent proximal policy optimization,MAPPO)算法,通过嵌入Elo评分系统的多对手训练方式缓解对手策略依赖性强的问题,算法流程如图2所示.

图2ASM2算法流程图

Fig.2Flow chart of ASM2

首先,将Elo评分Ei(t + 1)归一化表示,作为选择概率随机选择对手策略,载入智能博弈环境. 再从智能博弈环境中提取博弈环境态势信息,并对数据信息进行筛选和归一化处理,将得到的全局状态S t、局部观测和联合奖励r t存入经验回放池中. Critic网络从经验回放池中获取全局状态S t和联合奖励r t,向Actor 网络输出状态值函数V t; Actor网络再从经验回放池中获取局部观测,向飞机智能体F、舰船智能体V 和潜艇智能体U发送联合动作at,同时将联合动作a t回传到经验回放池中. 红方的智能体根据Actor网络输出的策略执行动作,更新博弈环境. 在一局推演结束后,返回当前对局胜负结果Wi(t),并结合由当前Elo 评分预估的对局胜率,更新当前对手下一局的 Elo评分Ei(t + 1).

4.1 基于MAPPO的多智能体博弈算法

PPO是目前效果最好的单智能体强化学习算法之一,它在传统策略梯度的方法的基础上添加了基线形成优势函数,并修改了传统的策略梯度公式,不使用ln π(a|s,θ),而是使用当前策略行动概率和上一策略行动概率的比值来衡量智能体的行动效果,即

(3)

PPO算法通过增加KL(Kullback-Leibler divergence)散度来约束参数θ的更新,或使用Clip函数将目标函数截断在一定的区间中,取截断后和未截断中较小的一方作为学习的最终目标函数. 这两种实现方式都缓解了传统的策略梯度方法中对更新步长十分敏感的问题: 若步长过小,容易陷入局部最优; 步长过大则会经常导致训练崩溃,效果越来越差.

MAPPO算法采用了中心式训练分散式执行框架(centealized training decentralized execution,CTDE)和 Actor-Critic架构,通过学习全局的Critic 网络来评估 Actor网络的策略,让各个单智能体 PPO相互配合. 其根据全局的状态S t学习中心值函数Vϕ(S t ),根据每个智能体局部的观测oi学习各自的策略,生成动作ai最大化回报. MAPPO算法训练Actor网络以最大化目标函数为

(4)

其中:

(5)

θ′表示旧策略, 为用广义优势估计(generalized advantage estimation,GAE)方法计算的优势函数,S 是策略熵,σ是策略熵的超参数,Bn表示batch size的大小.

训练Critic网络以最小化损失函数为

(6)

其中为折扣回报.

MAPPO算法在采样效率方面,与off-policy方法(如多智能体深度确定性策略梯度算法(multi-agent deep deterministic policy gradient,MADDPG)[21]、混合Q函数算法(Q-value mixing,QMIX)[22])相比也具有一定的优势. 因此,ASM2以MAPPO分布式多智能体博弈算法为基础,解决智能博弈问题.

4.2 嵌入Elo评分系统的多对手训练框架设计

使用强化学习方法解决智能博弈问题时,若只选择一个对手进行训练,对抗情况单一,智能体易收敛到针对特定对手的策略,算法泛化能力较差,难以得到足够智能的智能体. 为了解决上述问题,本文选择不同类型的专家对手策略供智能体训练,并设计了面向多对手的嵌入Elo评分系统的训练框架,保证训练的有效性.

Elo评分系统 [17] 是美国籍匈牙利物理学家Arpad Elo创建的衡量博弈活动的统计学方法,被广泛应用于体育竞技比赛如足球、围棋、国际象棋,和电子竞技游戏如王者荣耀、英雄联盟中. Elo评分系统用积分衡量玩家的水平,每场对局结束后,赢家会根据玩家积分差异获得输家的积分.

假设i和j是对战的双方玩家,用Ei(t)和Ej (t)表示在对局t中双方的Elo评分. 根据Elo评分系统,选手 i在对局t中战胜选手j的概率定义为

(7)

其中C为常数. 对局结束后,玩家i的Elo评分由以下公式进行更新:

(8)

其中: Ei(t)是更新前的Elo评分; Ei(t + 1)是更新后的Elo评分; Ki(t)是一个正比例因子,决定Elo评级改变的幅度; Wi(t)由对局结果决定,玩家i赢得比赛赋值为1,反之为0; 由公式决定,表示预估的对局胜率,若胜率过高,获胜加分会较少,失败会减更多的分数.

本文设计了包括抱团进攻、分散进攻、诱饵引诱等共计10种专家策略供智能体训练,提升智能体博弈水平. 不同专家策略区别主要体现在导弹火力分配方式、编队类型和进攻路线上,如图3所示.

在训练中,算法会根据胜率选择对手策略,智能体的对阵胜率越低,该对手策略被选择的概率就会越大,大大提高了有效样本的利用率. 该训练框架一定程度上缓解了策略遗忘和策略过拟合问题,提高智能体对阵各种策略的综合胜率.

5 仿真设计与结果分析

5.1 博弈平台与想定设置

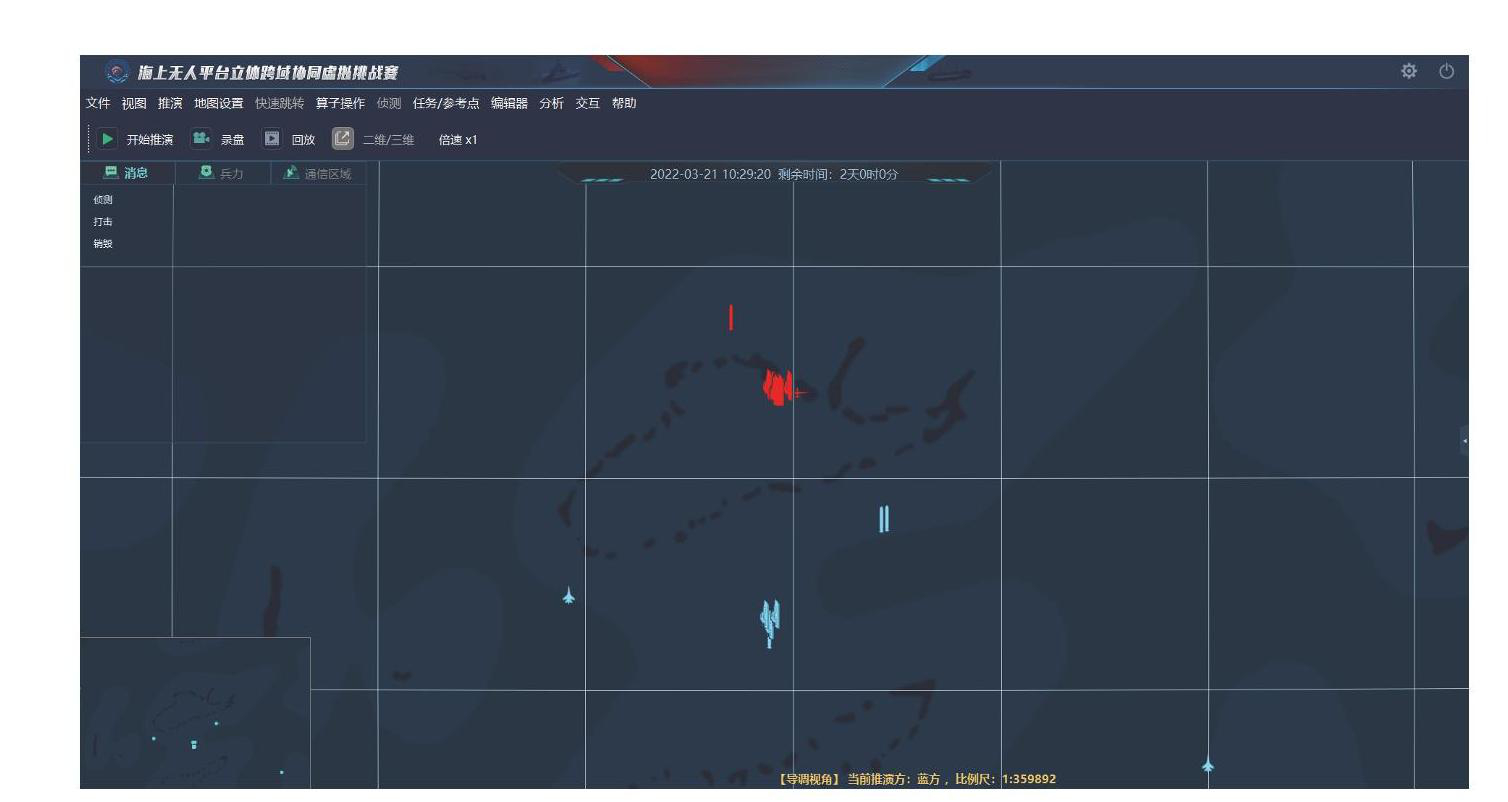

本文选用《2022海上无人平台立体跨域协同虚拟挑战赛》博弈推演平台进行实验验证,综合运用无人机、无人艇、无人潜航器集群,进行红蓝对抗,检验所提ASM2算法的指挥决策能力. 该平台提供可视化前端界面和python接口,与后台管理程序通信获取作战单元相关信息,图4为博弈推演平台示意图.

仿真想定以“雷达攻防”为任务背景,围绕红方雷达站开展立体攻防对抗. 双方战力如表7–8所示,其中红方为防守方,由多智能体算法操控; 蓝方为进攻方,由预设专家规则策略操控.

图3多种对手策略

Fig.3Multiple opponent strategies

图4博弈推演平台示意图

Fig.4Schematic diagram of game deduction platform

5.2 训练结果分析

在上述想定中,使用第2章论述的问题构建与形式化方法,采用所提ASM2海空联合博弈算法框架进行训练,并与采用相同形式化方法和训练框架的QMIX多智能体博弈算法进行对比分析. QMIX算法是最具代表性的多智能体强化学习算法之一,其采用值函数分解的思想,根据智能体对联合回报的贡献大小分解全局Q函数,在智能博弈问题中取得了卓越的效果,因此选择QMIX算法作为对比的强化学习基线方法.

表7红方兵力设置

Table7Red side force setting

表8蓝方兵力设置

Table8Blue side force setting

在实际训练中,使用的CPU为Intel(R)Core(TM)i9-10900K CPU@3.70 GHz,GPU为NVIDIA GeForce RTX 2080 Ti,训练时长为12小时,以确保足够的迭代次数及训练的稳定性.

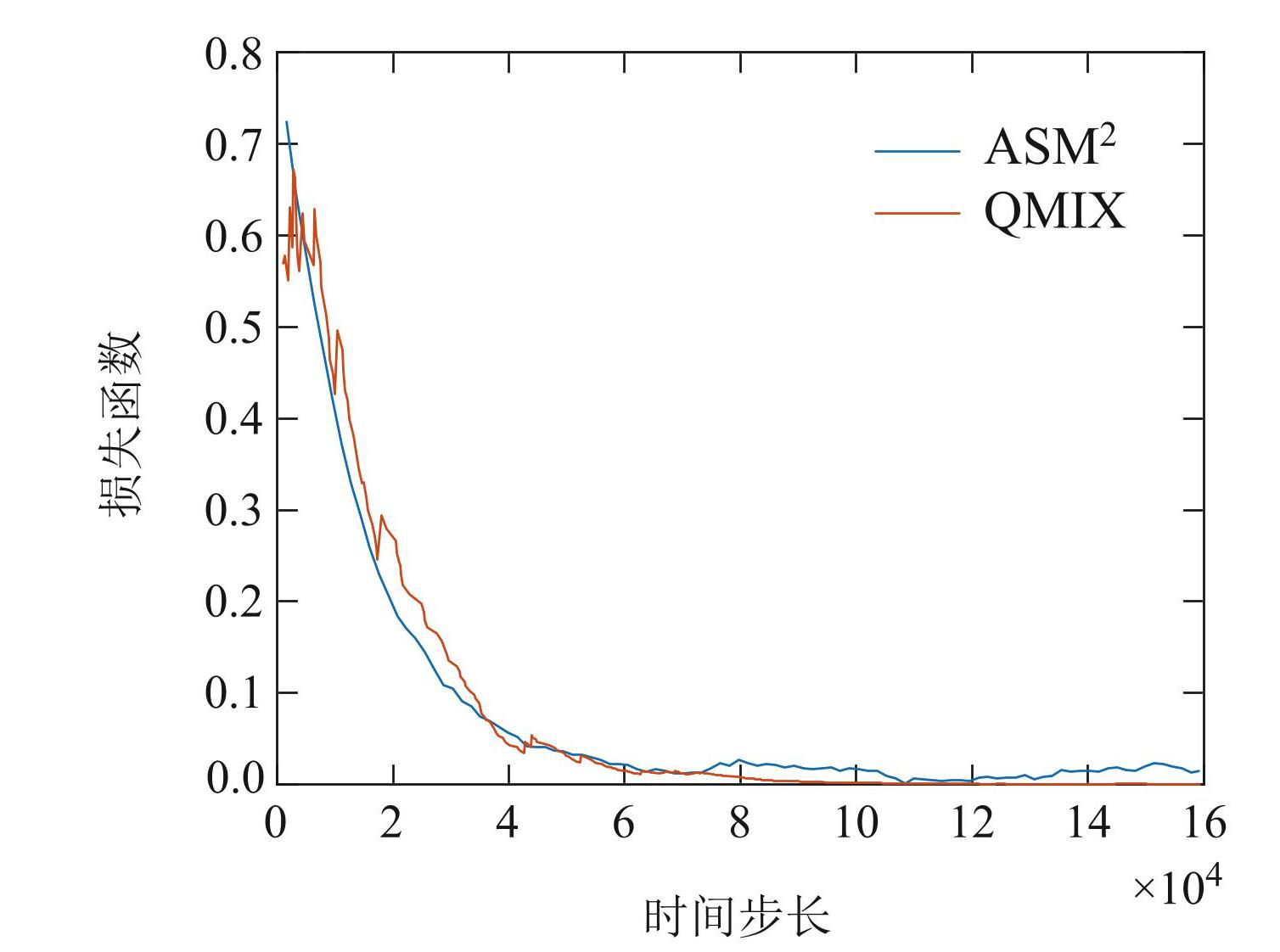

训练过程中ASM2算法和QMIX算法损失函数曲线如图5所示,其中: 横轴为时间步,纵轴为损失函数值. 随着训练的进行,两种算法的损失函数都呈现震荡下降的趋势,并向零逐渐逼近,说明网络预测值与真实值之差慢慢减小,训练有效.

图5损失函数曲线图

Fig.5Loss function graph

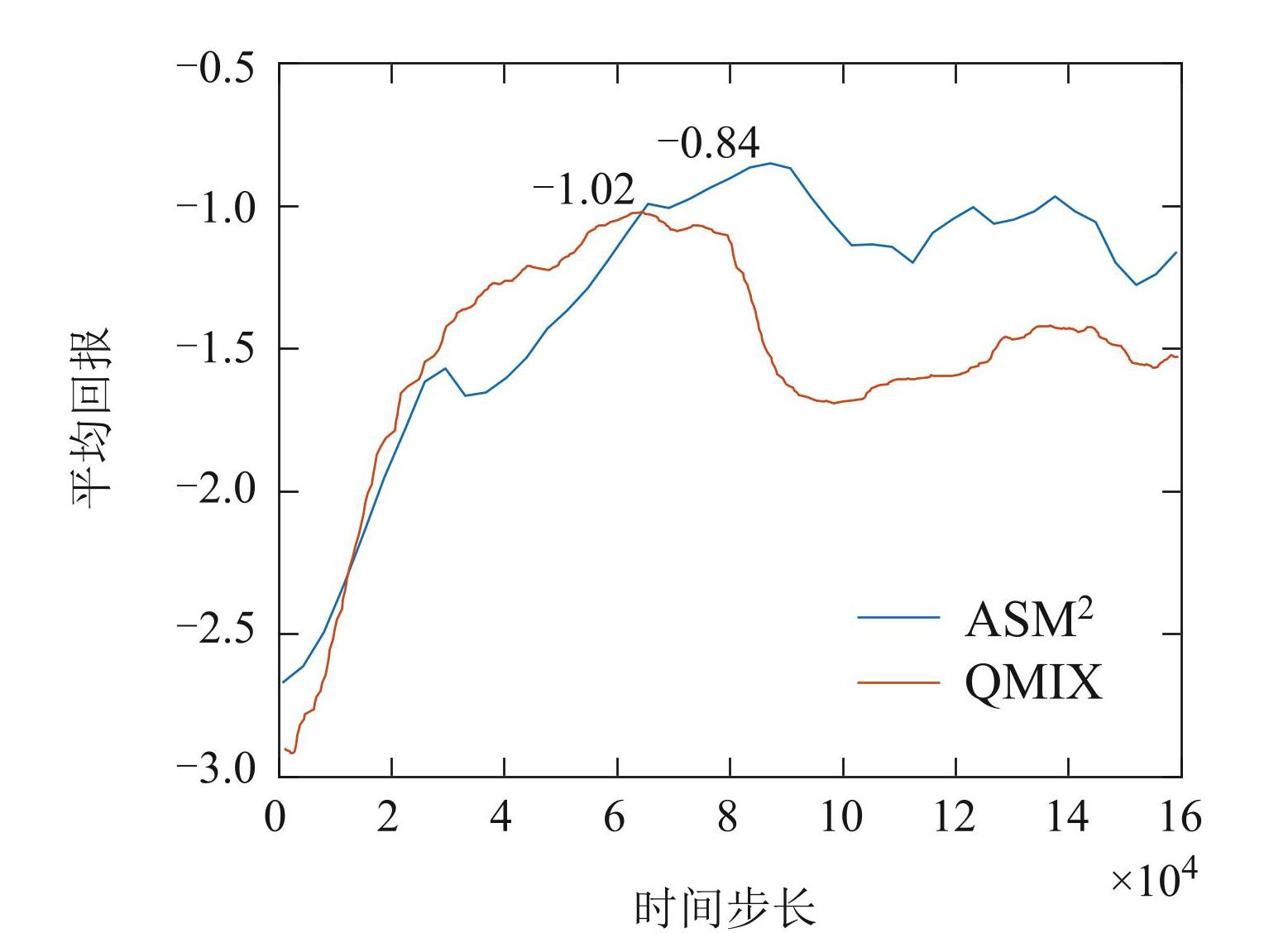

ASM2 算法和 QMIX算法平均回报曲线如图6所示,其中: 横轴为时间步,纵轴为平均回报. ASM2算法的平均回报随着训练轮次的增加总体呈现上升趋势,上升峰值达到−0.84,最后在−1上下波动,说明训练在朝着正确的方向进行,智能体博弈水平在不断提高; QMIX 算法的平均回报上升峰值为−1.02,最后在 −1.5上下波动. 与QMIX算法相比,ASM2算法训练效果更好,更加稳定.

图6平均回报曲线图

Fig.6Average return graph

5.3 测试效果分析

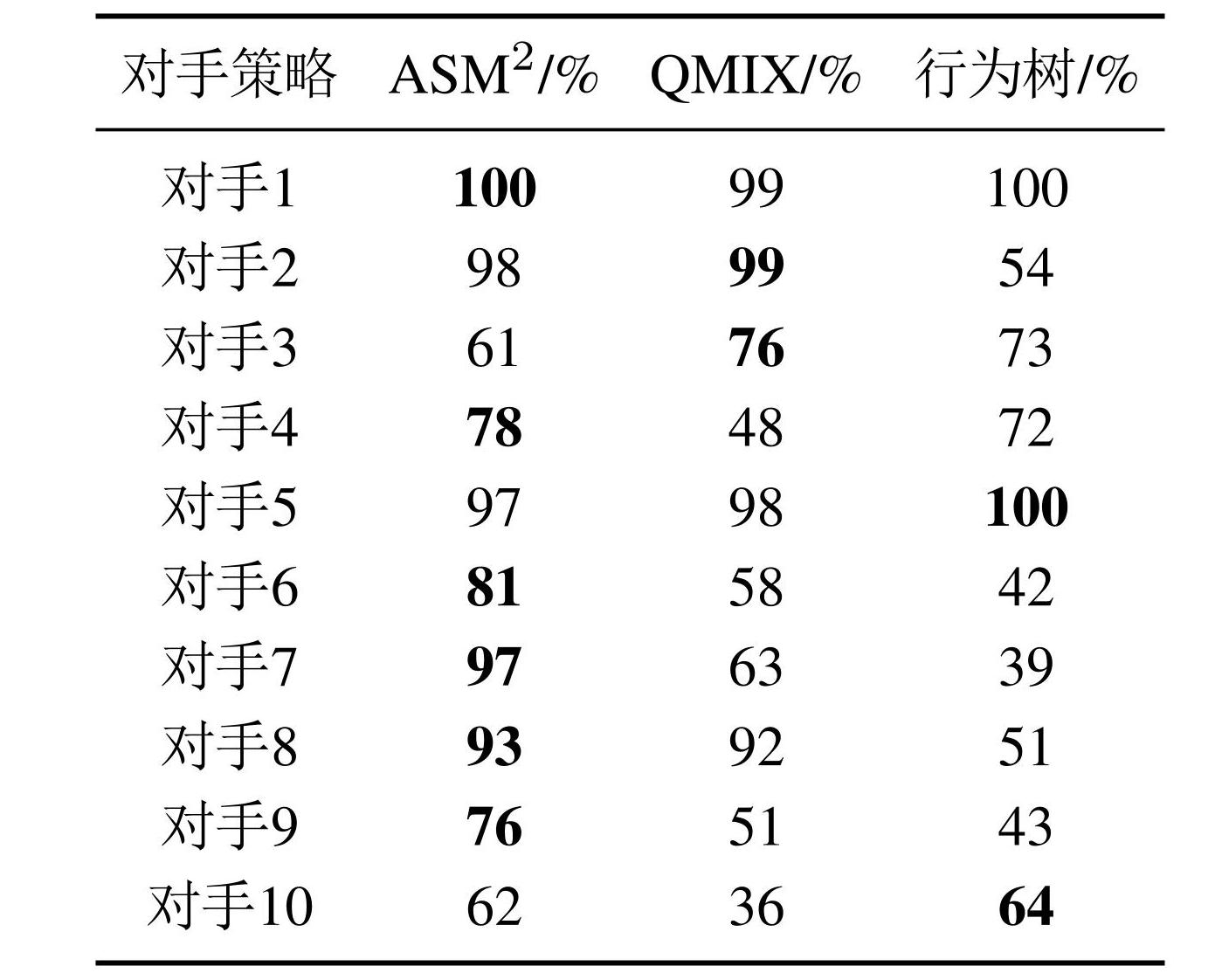

为了测试ASM2海空联合博弈算法效果,使用所提算法与10种专家对手策略(包括分散进攻、中间十路、分散五路中间诱饵、分散五路无诱饵、中间一路、中间两路不同角度进攻、8/8/14三路两航路点、9/9/12 三路一航路点、10/20中右两路进攻、三路进攻左侧绕远主攻策略)对抗. 除了上节提到的QMIX算法,本文还引入了基于行为树的专家规则方法作为另一个比较对象. 基于行为树的专家规则方法具有高度模块化的特点,因其直观性和可解释性得到了广泛的应用. 统计的胜率结果如表9所示.

表9算法测试胜率表

Table9Test winning rate table

由表9可知,对于对手1,2,5,7,8,训练后的ASM2 算法模型都能保持超过90%的极高胜率; 对于对手3,4,6,9,10,ASM2算法模型都能保持超过60%的较高胜率. 经对比,观察到QMIX算法在特定场景,如与对手3的对抗中,其胜率超越了ASM2算法; 同样地,基于行为树的专家规则方法在与对手5的交锋中表现出了卓越的胜率,这些结果揭示了不同算法在特定策略对抗中的潜在优势. 但总体而言,ASM2算法在多数对手策略上都维持了较为稳定的胜率,证明其具有广泛的适应性和较高的博弈水平.

另外,当对手策略不是表9中的策略时,算法模型也具有一定的适用性. 本文设计了无具体章法策略、侧面绕后进攻策略和延时进攻策略作为新对手,上述策略与表9中的策略在编队数量、行进路线、进攻时间上有较大的差异. 对于上述未训练过的新对手,未经调整的ASM2算法模型在对抗时也表现出了很高的胜率,分别为 81%,72% 和 85%,而QMIX算法模型胜率分别为55%,63%,57%. 这充分表明了本文所提 ASM2算法具有良好的泛化能力.

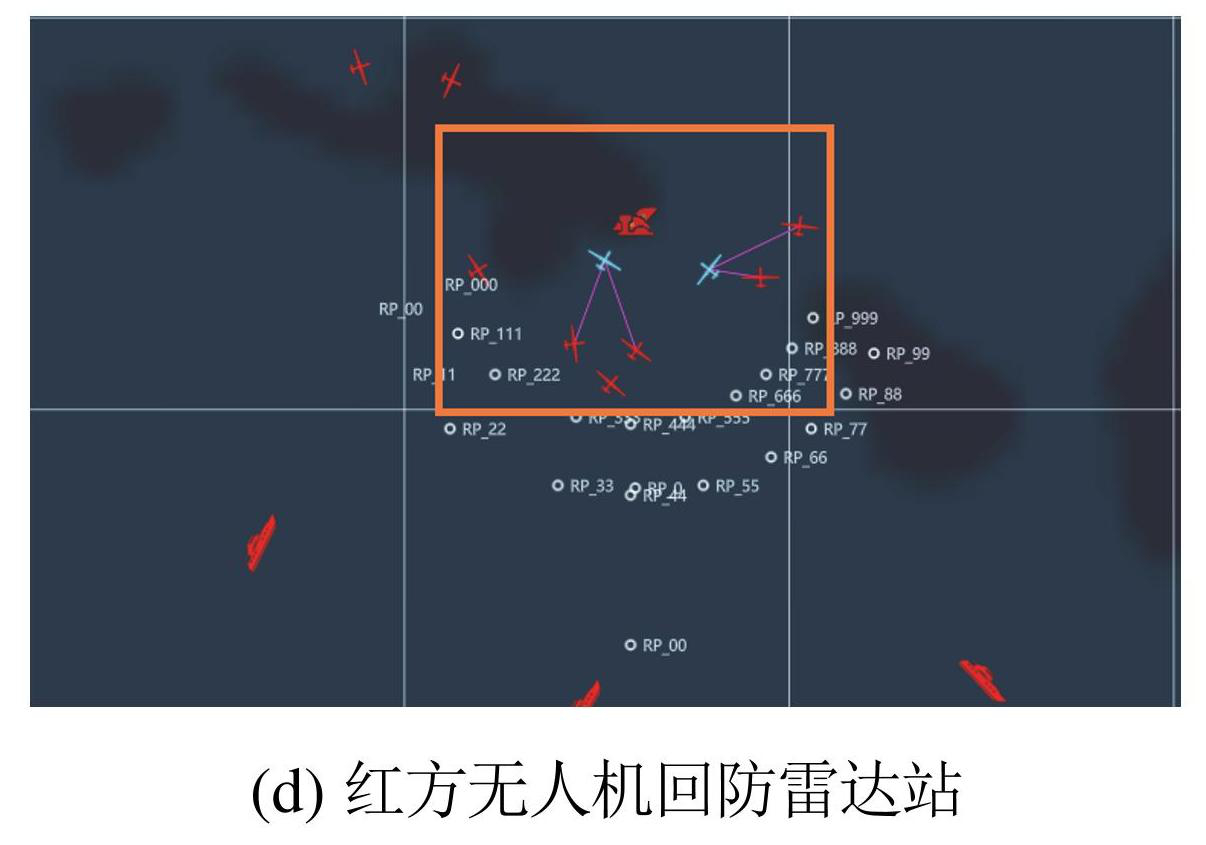

接下来,通过一组序列图具体分析所提算法与蓝方对手策略8的对抗效果. 如图7所示,蓝方对手策略 8先发射导弹击毁红方两架察打一体无人机,随后派遣30架自杀式无人机以三机十编队前进. 红方ASM2 算法模型派遣察打一体无人机在雷达站下方区域巡逻,先发射导弹攻击右方编队,再按从右到左的顺序用激光武器歼灭无人机编队. 蓝方无人机靠近雷达站后,红方无人机回防,成功守住雷达站.

图7对阵蓝方对手策略八序列图

Fig.7Sequence diagram of competing against the eighth blue opponent strategy

上述结果说明,面对多种不同的专家策略,训练后的智能体模型都能展现较高的博弈水平,验证了本文提出的ASM2海空联合智能博弈算法的有效性,并具有一定通用性和泛化能力.

6 结论

本文针对海空联合多智能体博弈对抗问题,首先设计了强化学习形式化建模方案,结合博弈环境态势状况,设定了全局和局部状态空间,充分表征了博弈环境中的多元信息; 设计了多智能体异构协同微操级动作空间,提高了各作战单元的机动性; 设计包含战损回报、区域回报和距离回报的多元稠密回报函数,充分发挥各作战单元的优势. 其次,提出ASM2海空联合智能博弈算法,通过嵌入Elo评分系统的多对手的训练方式缓解对手策略依赖性强的问题. 测试结果表明,训练后的ASM2智能体模型有较高的博弈水平,能有效应对多种不同的专家策略,具备一定的泛化能力.