摘要

在智能交通系统中, 交通流预测在交通管理和减少拥堵方面发挥着关键作用. 本文旨在开发一种高效、非迭代的神经网络方法用于交通流短时预测, 该方法被称为改进分数阶极限学习机(IFra-ELM). 通过分数岭回归算法, 使得ELM算法在求解输出权重时具有更好的性能, 该方法被称为分数极限学习机(Fra-ELM). 在输入层之后添加改进分数阶累加层, 将与原始输入进行拼接, 增强了ELM算法的特征提取能力. 通过改进分数阶累加层与分数极限学习机相结合, 增强了模型对于不同场景下交通流的预测能力和鲁棒性. 实验结果表明, 与传统方法相比, IFraELM模型在交通流预测方面具有优越的性能. 该框架有潜力提高交通预测系统的准确性和效率, 有助于智能交通基础设施的发展.

关键词

Abstract

In intelligent transportation systems, traffic flow prediction plays a key role in traffic management and congestion reduction. The current manuscript aims to develop an efficient, non-iterative neural network method for short-term prediction of traffic flow, which is called improved fractional order extreme learning machine (IFra-ELM). Through the fractional ridge regression algorithm, the ELM algorithm has better performance in solving the output weight. This method is called a fractional extreme learning machine (Fra-ELM). An improved fractional-order accumulation layer is added after the input layer to splice it with the original input, which enhances the feature extraction capability of the ELM algorithm. By combining the improved fractional-order cumulative layer with the fractional extreme learning machine, the model’s prediction ability and robustness for traffic flow in different scenarios are enhanced. Experimental results show that compared with traditional methods, the IFra-ELM model has superior performance in traffic flow prediction. This framework has the potential to improve the accuracy and efficiency of traffic prediction systems and contribute to the development of smart transportation infrastructure.

1 引言

智能交通系统以城市道路交通流量预测作为关键技术. 短期交通流预测是利用动态获取的道路交通流状态数据来预测未来的交通流状态. 为此,对于高速公路场景下,进行准确、实时地预测短期交通流对于分析路网交通、规划交通网络和控制高速公路交通具有重要作用. 很多发展中国家在交通流量采集中没有大规模安装数据采集传感器,仅仅在关键节点采集数据. 为此,孤立节点单变量交通流量预测建模研究具有重要的理论价值和现实意义 [1] .

目前,国内外针对孤立节点单变量交通流量预测模型可大致分为3类: 统计学习方法、机器学习模型以及神经网络模型. 统计学习方法包括最经典的差分自回归移动平均模型(autoregressive integrated moving average model,ARIMA)、指数平滑模型和卡尔曼滤波模型. Li等人 [2] 提出一种自适应混合阶指数平滑算法,通过不同的指数平滑算法自适应组合,加强了对交通流中的非线性关系的捕捉. 韩超等人 [3] 提出一种通过遗忘递推最小二乘方法进行参数估计的ARIMA 模型对交通流进行了有效预测. Chen 等人 [4] 将线性 ARIMA 模型和非线性广义自回归条件异方差模型(generalized autoregressive conditional heteroskedasticity,GARCH)进行组合预测,因此能够同时捕捉交通流序列的条件均值和条件异方差性. Lin等人 [5] 在ARIMA-GARCH模型的基础上提出了ARIMA-GARCHM模型,精度进一步提高. Shahriari等人 [6] 将Bootstrap 与传统的参数ARIMA模型相结合,旨在提高预测精度. Nieto 等人 [7] 将上述优化方法进行了结合,设计了 ARIMAGA-RCH-Bootstrap 时间序列预测方法,同时考虑流量数据的趋势和季节性、数据可变性,得到了更准确的预测结果. Guo等人 [8-9] 研究了可以更新过程方差的自适应卡尔曼滤模型. 但是统计模型在数据较大情况下,对于交通流的非线性信息挖掘能力较弱,虽然有很多方法改进模型,但是仍然无法做解决复杂的时空动态性,预测性能仍需进一步提升.

随着机器学习模型广泛的应用 [10-13],机器学习方法也被引入了对交通流建模之中. 支持向量机(support vector machine,SVM)、神经网络和集成学习是代表性模型. Zhang等人 [14] 提出一种用于小样本时间序列的集成机器学习方法. Chen等人 [15] 提出了一种交通状态感知集成方法,来集成图神经网络进行交通流预测. Feng等人 [16] 提出了一种混合核支持向量回归模型,可以根据流量的变化自动调整权重. 同时,通过时空信息对模型进行改进. Sun等人 [17] 提供了一种基于粒子群优化的改进SVM模型,与SVM和其他算法相比,以更少的建模时间和更高的检测精度实现了更好的整体检测性能. 冒云香等人 [18] 提出了并行随机森林的短时交通流预测方法,保证精度的同时,提高了随机森林的运行效率. SVM直接利用该空间的核函数进行计算,可以有效避免高维空间的复杂性,但需要大量的存储空间,这对于大规模的训练样本来说是很难实现的. 同理,集成学习方法构建多个模型同样需要大量存储空间和较高的时间复杂度.

与SVM算法和集成学习相比,神经网络算法中的极限学习机算法(extreme learning machine,ELM)的运行效率高. ELM由Huang等人 [19-20] 提出,是一种具有单个隐藏层的前馈神经网络. 与传统的神经网络训练方法不同,ELM会随机将输入权重分配给隐藏节点,并通过求解一组线性方程来得出输出权重. ELM 具有训练速度极快、泛化能力强、参数调整难度低等优点. 正则化ELM方法将输出权重的范数纳入目标函数的正则化项中,通过降低结构风险,显著提高ELM 的学习效率 [21] . 王快妮等人 [22-24] 则从ELM的鲁棒性作为研究的出发点,通过引入损失函数,在不同范数约束下,提升了ELM的鲁棒性和预测能力. 夏晶晶等人 [25] 提出了一种改进蝴蝶算法优化核极限学习机结合相空间重构的短时交通流预测模型,通过混沌理论和实测数据验证,实现了实时准确的混沌交通流预测. 蔡浩等人 [26] 通过嵌入原子搜索算法优化极限学习机,构建结合原子搜索优化的极限学习机算法(atom search optimization ELM,ASO-ELM)短期交通流预测混合优化模型,实验结果表明该模型在短期交通流预测中的表现优于传统模型. 李嘉春等人 [27] 提出了一种基于烟花差分进化混合算法优化极限学习机的短时交通流预测方法,通过奇异谱分析降噪和相空间重构优化参数,显著提高了预测精度和泛化能力. Yang等人 [28] 的工作与之前不同,使用极限学习机(ELM)来预测交通流量,并使用田口方法来优化模型. Cai 等人 [29] 针对影响交通流预测效果的非线性关系,提出了一种基于粒子群优化(particle swarm optimization,PSO)的ELM算法,称为 PSO-ELM,用于交通流短时预测. 该模型使用粒子群优化算法来搜索最优全局解,并使用极限学习机来快速识别处理非线性关系的优势. 该模型提高了交通流预测的准确性. Li等人 [2] 利用极限学习机算法计算自适应混合阶指数平滑算法的残差校正,然后利用量子粒子群优化参数,进一步提高交通流预测精度. 为了量化短期交通量预测的不确定性. Cui等人 [30] 设计了一种基于GSA和ELM的混合机器学习模型. 上述算法都使用了进化算法或者启发式算法优化ELM算法,这种方法虽然有效提高了算法预测的精度,但是也引入了迭代学习,增加了时间成本.

本文针对在高速公路交通场景下,缺失空间信息的孤立交通流节点的预测问题,提出了一种基于改进分数阶优化的极限学习机算法. 本文主要贡献如下:

1)提出通过分数岭回归算法对ELM算法的输出权重进行求解,改进传统极限学习机的预测精度,该方法被称为分数极限学习机(fractional ELM,FraELM);

2)提出了一种改进分数阶累加层,通过给 FraELM算法添加深度,同时也可以捕捉交通流片段变换的高阶特征,从而提升预测精度,该方法被称为改进分数阶极限学习机(improving Fra-ELM,IFra-ELM);

3)预测实验表明,IFra-ELM在各项评价指标方面均优于基准模型,并且在40个数据集进行测试表现出了更好的泛化能力.

2 算法原理

2.1 分数极限学习机(Fra-ELM)

使用单层前馈神经网络(single-layer feedforward neural network,SLFN)作为ELM的基础 [19] . 首先通过随机化隐藏层的权重和阈值,采用最小二乘法来调整 ELM神经网络中的输出权重 [20] . 由于其独特的训练过程,前馈神经网络无法以与ELM神经网络相同的速度解决回归预测问题. 图1展示了ELM算法的结构.

图1ELM算法结构图

Fig.1ELM algorithm structure diagram

假设有N组训练样本其中ELM隐藏层包含L神经元,ELM的输出为

(1)

其中: e(·)是激励函数; Wi = [wj1 wj2 · · · wjn] 是隐藏层第i个神经元与每个输入层神经元之间的连接权值; βi = [βj1 βj2 · · · βjn] T是隐藏层第 i 个神经元之间的连接权值每个输出层神经元; bi是隐藏层中第i个神经元的阈值. 为了最小化单个隐含层的输出误差以达到学习目标,式(2)可以表示为

(2)

ELM模型可以表示为如下优化问题:

(3)

其中: β是隐藏层和输出层的连接权值矩阵; β †是式(3)的解; T是期望的输出; H为神经网络隐藏层的输出矩阵; 根据最优性条件,优化式(3)的最优解为

(4)

其中: I是单位矩阵,C是正则化参数,该模型也被成为正则极限学习机. 为了计算效率,众所周知,可以使用矩阵H的奇异值分解(singular value decomposition,SVD)来重写原始问题 [31],即

(5)

其中: U的维度为d × p,S的维度为p × p, V 的维度为 p × p. S是方阵,即

(6)

以λi作为奇异值,从最大到最小排序. 将矩阵H替换为其SVD,可以得到

(7)

假设U和V 是酉矩阵(例如,U TU是I),将每一边左乘于UT得

(8)

令和这些是原始量(y,β 和ϵ)通过酉矩阵UT和VT的变换(旋转). 在p<d的情况下,这也会将数量投影到维度为p的低维空间中. 在此空间中可以得到最小二乘解(ordinary least squares,OLS),即

(9)

简化为以下内容:

(10)

其中

S−2是奇异值矩阵S的平方的逆. 因此,对于低维空间中的单个坐标i,可以通过标量乘法来解决OLS问题,即

(11)

最终简化为

(12)

上述基于SVD的回归重新表述也非常有用,因为它提供了对岭回归本质的深入了解 [32] . 具体来说,考虑低维空间中的岭回归解,即

(13)

计算

最后,代入式(13),得到

(14)

这表明在低维空间中,岭回归可以使用标量运算来求解. 为了进一步说明岭回归和OLS解之间的关系,通过将式(12)代入式(14),观察到以下结果:

(15)

换句话说,岭回归系数只是OLS系数的按比例缩小,每个系数的收缩量不同. 与较大奇异值相关的系数比较与较小奇异值相关的系数收缩得较小. 为了获得原始空间中的解,将系数与V 左乘,即

Fra-ELM的核心概念是根据应用于求解L2范数的收缩量来重新参数化. 具体来说,将分数γ定义如下:

(16)

由于V 是酉变换,低维空间中系数解的L2范数与系数的L2范数相同原始空间中的解这样,就可以完全在低维空间内进行操作,并保证分数保持在原始空间中. 在Fra-ELM中,没有指定α的期望值,而是指定介于1(无正则化)和0(完全正则化,对应于将所有系数缩小到β = 0)之间的γ值. 计算γ特定期望值的岭回归解,根据式(11)和式(14),很容易计算出与特定给定α值对应的γ值,即

在某些特殊情况下,这种计算可以大大简化. 例如,如果X的奇异值谱是平坦的(λi = λj 对于任何i≠ j),可以将所有奇异值设置为λ,产生以下结果:

然后,可以求解

因此,在这种情况下,存在适当的 α 值的解析解. 那么就可以使用式(14)求解 Fra-ELM算法的输出权重.

2.2 改进分数阶累加特征提取方法

一阶累积法广泛应用于灰色预测模型中,第1步为假设序列. 假设有一个序列为

(17)

该序列是原始序列,则原始数据序列的累加序列为

(18)

为了有效利用时间序列中的有效信息,分数阶累加算子被采用

(19)

其中: k = 1,2,· · ·,n; r是实数.

(20)

计算完累加序列后,需要计算灰色累加序列的背景值

(21)

通常的计算方法是利用数值积分的梯形公式计算 r阶累积序列的背景值

(22)

为了更好地计算背景值的积分结果,本文采用 Newton-Cote求积法进行改进. 如果积分区间[a,b]被分成 n等份,则写为以等分点xi =a + ih(i = 0,1,2,· · ·, n)为数值积分的节点,由此构造插值数值积分公式,即

(23)

该公式称为Newton-Cote求积公式,称为NewtonCote系数,与积分区间无关,并且

(24)

要使用Newton-Cote求积,需要知道[k,k + 1]区间内某个点或多个点x (1)的值. 但是,原始数据中没有这样的数据,所以采用插值的方法来获取,对所有数据进行插值,如果此时数据量较大,会因为高阶插值的数值不稳定而影响精度,为了克服这个困难,使用最近邻插值法

(25)

式(25)称为前向邻最近插值法.

本文采用的背景值是通过Newton-Cote求积公式(n = 4)得到

(26)

通过后向最近邻插值法,得到背景直线计算公式为

(27)

改进分数阶累加方法可以作为一种有效的特征提取方法,添加到Fra-ELM算法中构建深层网络结构.

2.3 改进分数阶极限学习机

本文通过在Fra-ELM算法中添加改进分数阶累加层和片段连接层,对Fra-ELM算法进行改进. 该算法被成为改进Fra-ELM算法(IFra-ELM),其结构图如图2所示.

输入数据经过改进的分数阶累加处理,得到了该交通流量序列的分数阶累加序列和改进背景值序列,这一步骤可能是为了增强输入数据的特征表示能力. 再通过片段连接层将原始交通流序列,分数阶累加序列和改进背景值序列进行连接处理,保证原始特征不退化. 通过引入改进的分数阶累加层和片段连接层,可能旨在提高极限学习机的性能和处理复杂数据的能力. 将连接好的数据输入隐藏层,最终通过 FraELM算法输出交通流量的预测值(注: 相较于 FraELM,IFra-ELM 具备更高效提取高阶特征的能力和泛化能力).

图2IFra-ELM算法结构图

Fig.2IFra-ELM algorithm structure diagram

3 实验分析

本文采用不同城市、不同路段的交通流量进行分析,验证了本文算法的可行性. 数据来自来自英国(UK)的11个数据集(11个观测站点),来自美国3条高速公路的 25个数据集(马里兰州(MD)、明尼苏达州(MN)和华盛顿州(WA),每个高速公路分别包含4个观测站点、10个观测站点和6个观测站点)[8],来自中国徐州市的 4个数据集(分别是丰县 S254 沙河、三环 G311徐庄、睢宁G104官山、新沂G205石涧,4 个观测站点)[9] . 本文采用均方根差(root mean square error,RMSE)、平均绝对误差(mean absolute error,MAE)和平均绝对百分比误差(mean absolute error,MAPE)作为交通流的预测精度评价指标.

3.1 Fra-ELM的预测表现

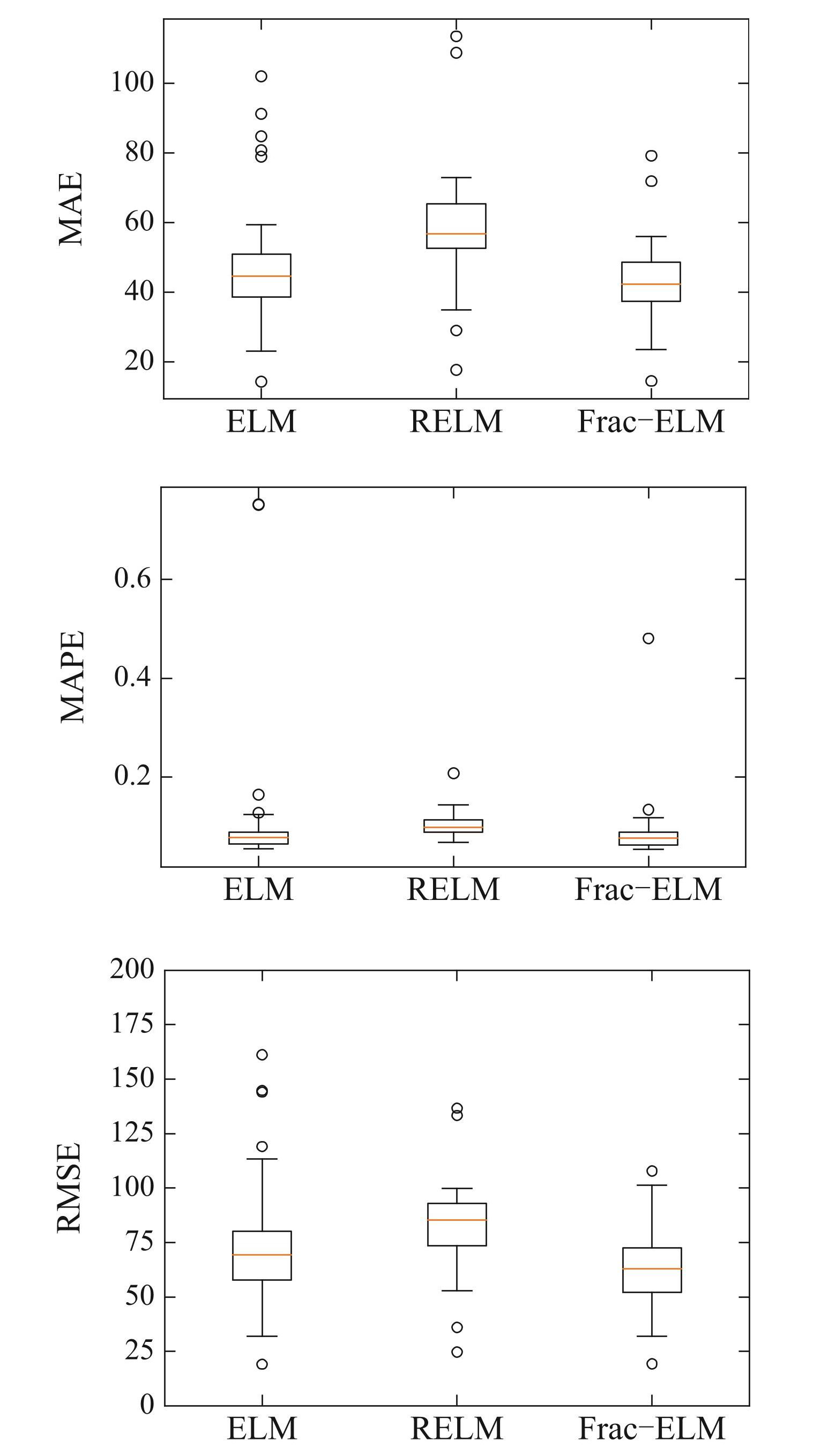

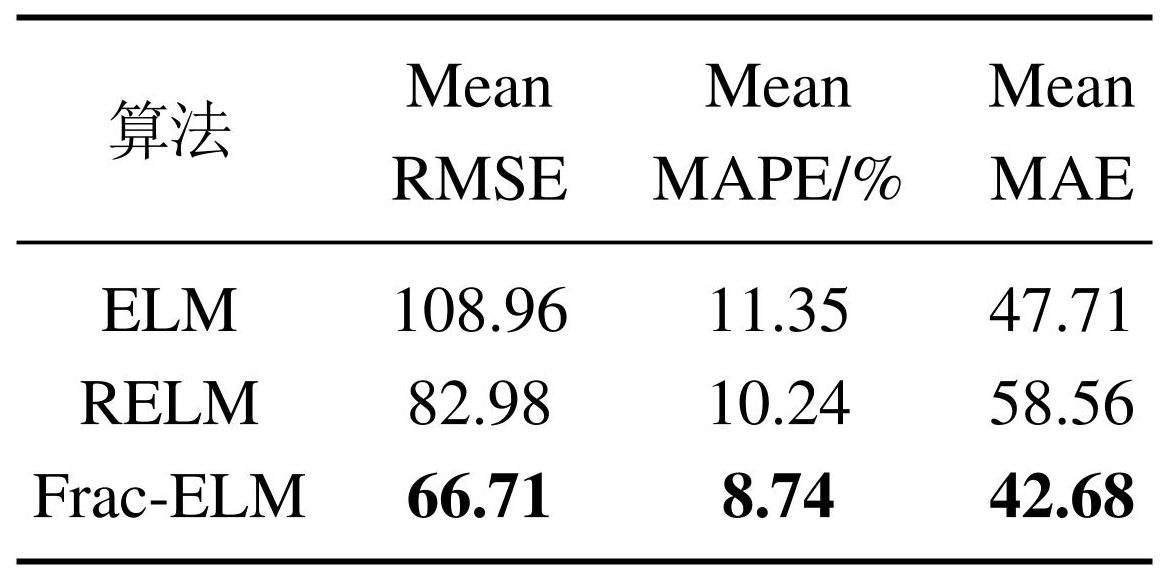

为了验证 Fra-ELM 的预测效果和有效性,本节采用15 min数据集进行实验,分别与 ELM和正则 ELM 进行比较. 其中所有ELM算法中的隐藏层个数为256. 选取36个不同交通流节点的前8周数据作为训练集,第9–10周作为测试集. Frac-ELM与ELM和RELM在 RMSE,MAPE和MAE上的性能比较如图3所示. 在40 个数据集上的平均表现如表1所示.

从表1可以发现,Frac-ELM算法相比ELM算法和 RELM 算法在精度上有着显著的提升. 相比 ELM算法,Mean RMSE 提升了约 38.77%,Mean MAPE提升了约22.98%,Mean MAE提升了约10.55%. 相比RELM算法: Mean RMSE 提升了约19.56%,Mean MAPE 提升了约14.66%,Mean MAE 提升了约27.13%. FracELM算法不仅继承了ELM和RELM算法的优点,还在此基础上实现了更高的预测精度,Frac-ELM算法在复杂情况下的交通流量能够有更好的预测能力.

图3Fra-ELM算法对比箱线图

Fig.3Fra-ELM algorithm comparison box plot

表1不同算法预测表现及对比

Table1Prediction performance and comparison of different algorithms

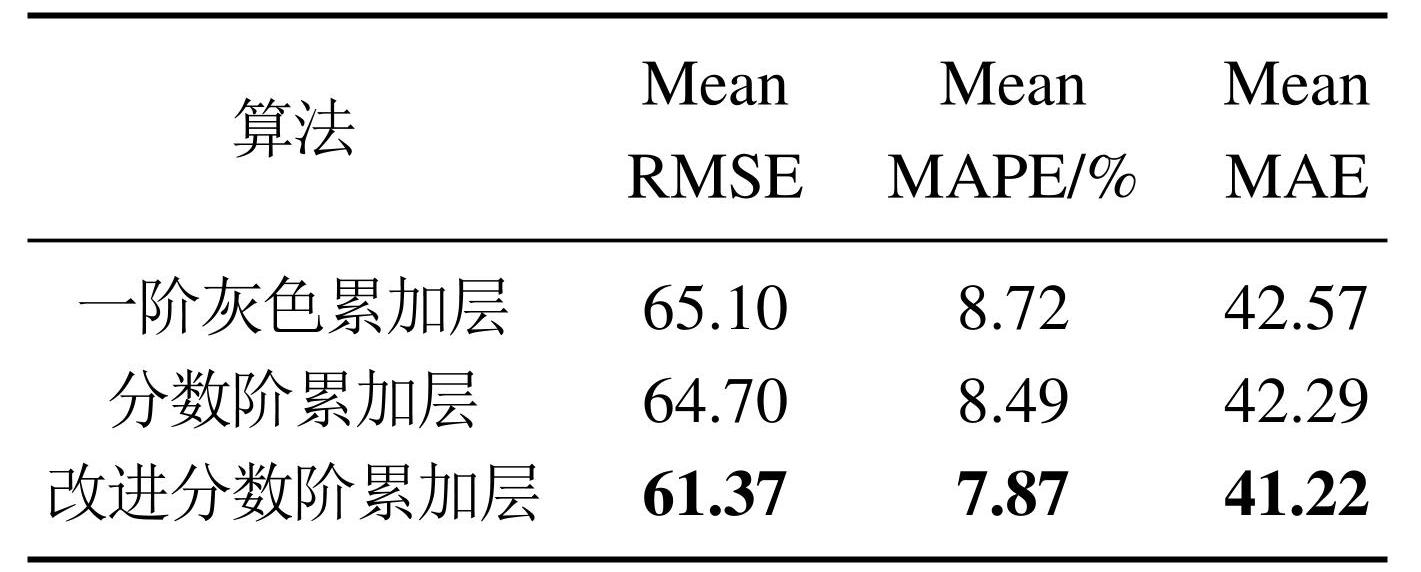

3.2 改进分数阶累加层的预测表现

为了验证改进分数阶累加层的有效性,本节采用15 min数据集进行实验,分别采用一阶灰色累加算子、分数阶累加算子和改进分数阶累加算子对FraELM 算法进行实验,采用同样的数据集划分,FraELM算法分别添加一阶灰色累加层、分数阶累加层和改进分数阶累加层的表现,如图4所示. 在40个数据集上的平均表现如表2所示.

图4不同累加层对于Fra-ELM算法预测精度对比箱线图

Fig.4Box plot comparing prediction accuracy of Fra-ELM algorithm with different accumulation layers

表2不同累加层对于Fra-ELM算法预测精度对比箱线图

Table2Box plot comparing prediction accuracy of FraELM algorithm with different accumulation layers

从表1和表2中可以发现,不同的累加层对FraELM算法的预测精度都有显著提升,其中改进的分数阶累加算法提升最为明显,能够有效提取出交通流数据中的高阶特征,提供更强的预测能力. 相比于FracELM算法,改进分数阶累加算法在Mean RMSE,Me-an MAPE和Mean MAE上分别提升了约5.15%,7.31% 和2.53%.

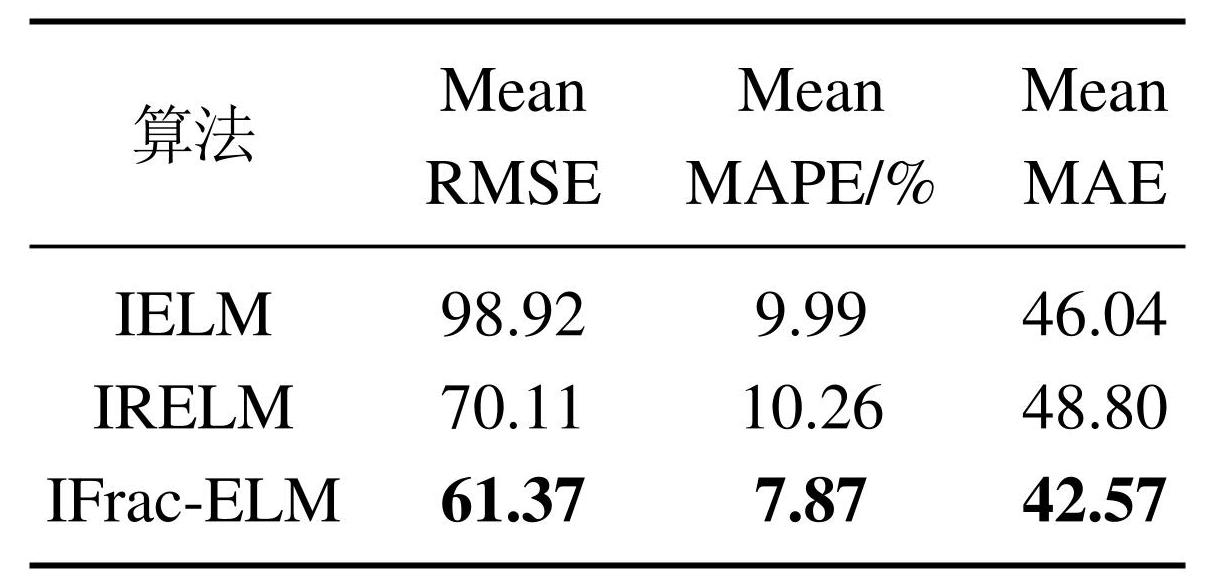

为了验证改进分数阶累加层的泛化能力,分别对 ELM和正则 ELM添加改进分数阶累加层,命名为 IELM和IRELM,与IFra-ELM算法采用相同的数据集进行实验. 其中所有ELM算法中的隐藏层个数为256. 在40个数据集上的平均表现如表3所示.

表3改进分数阶累加层对于不同算法预测表现及对比

Table3Improved fractional-order cumulative layer prediction performance and comparison of different algorithms

从表1和表3对比可知,改进分数阶累加层能够有效提升不同ELM算法的预测精度,其中IFrac-ELM相较于Frac-ELM算法在Mean MAPE 指标上提升了约 10.03%,进一步提升了算法预测的稳定性.

3.3 与常用模型的比较

为了测试该算法并证明其泛化性,并进行了广泛的测试. 选择每个数据集的前8周作为训练集,第9周和第10周作为每个模型的测试集. 本文将IFra-ELM 与其他常用的交通流模型进行比较,包括ARIMA、多感知机(multilayer perceptron,MLP)、K近邻(K nearest neighbor,KNN)、决策树(decision tree,DT)和SVM. 集成学习模型包括XGBoost [36]、Catboost [37]、轻量级梯度提升机(light gradient boosting machine,LGB)[38] 和随机森林算法(random forest,RF)[18] . 使用Python的Scikit-learn [39] 库用于机器学习算法实现基线模型,参数使用推荐的默认参数. 同时与常用的基于深度学习的交通流预测模型、堆叠自编码器(stacked autoencoders,SAE)[40]、门控循环单元(gated recurrent unit,GRU)[41]、长短期记忆网络(long short-term memory,LSTM)[42] 和时间卷积网络(temporal convolutional network,TCN)[43] 进行了对比. 深度学习模型使用了Adam算法作为优化器,学习率设置为0.001.

为了更好的分析算法性能,本文选取了表现前10 的算法,对它们在40个交通流观测站点上的MAPE,MAE,RMSE绘制箱线图,如图5所示.

从图5中,可以观察到本文提出的IFra-ELM算法有更好的泛化能力,在不同的数据集相比之下有更好的表现. 为了本节对比了17种不同的机器学习模型,具体表现如表4所示.

图5不同算法预测精度对比箱线图

Fig.5Box plot comparing prediction accuracy of different algorithms

从表4中,可以发现IFra-ELM算法在所有指标上都表现最佳,具有最低的均方根误差、平均绝对百分比误差和平均绝对误差. IFra-ELM算法的Mean RMSE为61.37,Mean MAPE误差为7.87%,Mean MAE为 42.57. 这些数值表明该算法相对其他算法更能准确地预测孤立节点的交通流量. 与深度学习算法相比,IFra-ELM算法在Mean MAPE和Mean MAE上分别提升了约 6.79%和6.38%,并且复杂度更低. 在孤立节点交通流中,本文算法比深度学习算法能更好地捕捉交通流片段中的非线性信息,从而有更好的预测效果. 在机器学习算法中,RF和LGB算法有着更好的表现,通过集成方法可以有效地提高在孤立节点的交通流预测效果,为此可以将IFra-ELM 模型作为基础模型,采用集成方法进一步提升预测能力.

4 总结

本文对针对缺失空间信息的孤立交通流节点的预测任务,提出了一种改进分数阶极限学习机的交通流预测方法. 根据交通流量存在的时间序列特征设计了改进分数阶累加层提取交通流高阶特征,采用分数岭回归改进ELM算法的输出权重求解,能够更好的预测交通流量.

改进分数阶累加层使模型具有较好的泛化能力,这是一种对于时间序列高阶特征捕捉的处理方式. 该模型也适用于处理医疗、气象、金融等领域的单变量时间序列的相关任务,并具自适应提取时间序列高阶特征的能力. 同时,采用分数岭回归算法求解的FraELM 算法相较正则 ELM 算法有着更好的泛化能力. IFra-ELM 具有良好的可拓展性,在未来将进一步探索基于进化算法的输入权重优化、结合集成方法等,使该模型的预测精度能够进一步提升,从而加强算法在复杂问题上的泛化能力.

表4IFra-ELM算法预测表现及对比

Table4IFra-ELM algorithm prediction performance and comparison