摘要

PID控制器在工业控制领域应用广泛, 其参数的选择过度依赖于人工经验, 效率低且过程繁琐. 近年来, 深度强化学习因其具有对复杂环境自学习的能力, 在很多领域取得了成功应用. 本文提出一种基于双经验回放池双延迟深度确定性策略梯度(TD3)算法的PID参数优化方法, 利用深度强化学习的方法, 自主优化PID控制器的参数. 在整个优化过程中, 将控制问题视为序列决策过程, 通过设计智能体的状态、动作空间以及网络结构, 将PID参数的优化过程转化为强化学习策略网络权重的更新过程. 同时, 针对TD3算法训练前期探索效率低的问题, 在TD3算法的基础上, 增加双经验回放池机制, 提升了算法训练前期的效率. 最后, 在二阶系统和一阶加纯时滞系统上进行仿真验证, 并与基于粒子群优化(PSO)算法优化PID参数的方法进行对比, 实验结果表明, 所提算法优化得到的PID参数在控制器上体现的控制性能要优于PSO算法.

Abstract

PID controller is widely used in the field of industrial control, the selection of its parameters is over-dependent on manual experience, the efficiency is low and the process is complicated. In recent years, deep reinforcement learning has been successfully applied in many fields because of its ability to self-learn from complex environments. In this paper, a PID parameter optimization method based on twin delayed deep deterministic policy gradient (TD3) algorithm of double replay buffer is proposed, and the parameters of PID controller are optimized by deep reinforcement learning. In the whole optimization process, the control problem is regarded as a sequence decision process. The optimization process of PID parameters is transformed into the updating process of the weights of the agent’s network by designing the state space, action space and the network structure of the agent. At the same time, to solve the problem of low exploration efficiency in the early stage of TD3 algorithm training, the double experience replay buffer mechanism is added on the basis of TD3 algorithm to improve the efficiency of the early stage of algorithm training. Finally, simulations are performed on the second-order system and first order plus delay time system, and compared with the PID parameter optimization method based on particle swarm optimization (PSO) algorithm. The experimental results show that the PID parameters optimized by the proposed algorithm have better control performance than the PSO algorithm.

Keywords

1 引言

在工业控制中,PID控制器一直是应用最广、也是最为成熟的控制器 [1] . 尽管在控制领域,各类新式的控制器层出不穷,但PID控制器仍然凭借其稳定性好、结构简单等优点 [2],占据着工业控制器的主导地位. PID控制系统的控制性能直接取决于比例系数(KP)、积分系数(KI)以及微分系数(KD)这3个参数,因此,如何整定这3个参数是PID控制器设计和应用的一个核心问题.

常规的PID工程整定方法需要依赖人工经验,获得的PID参数往往无法取得满意的控制性能,还需要人工在线调整. 近年来,群智能优化算法,如遗传算法(genetic algorithm,GA)、粒子群算法(particle swarm optimization,PSO)等,在PID参数优化中得到了成功的应用 [3-6],但基于智能优化算法的PID整定方法依赖被控对象的准确模型,而在实际生产中,过程的准确模型难以获得,这也限制了该方法的实际应用. 因此,研究不依赖过程对象模型,并减少对人工经验依赖的 PID参数优化方法具有重要意义.

随着人工智能技术的发展,以深度学习、强化学习为代表的机器学习方法在许多工业领域得到了成功应用 [7-10] .2015年,Mnih等人 [11] 提出了结合强化学习和深度学习的DQN算法. 该算法在雅达利游戏上取得了与人类玩家相当的水平,这一开创性的工作推动了深度强化学习的发展,同时也是当前主流深度强化学习算法,例如近端策略优化算法(proximal policy optimization,PPO)[12]、深度确定性策略梯度算法(deep deterministic policy gradient,DDPG)[13]、双延迟深度确定性策略梯度算法(twin delayed deep deterministic policy gradient,TD3)[14] 的基础. 强化学习利用智能体与环境进行交互,通过奖励机制来引导智能体的策略朝着奖励最大化的方向前进. 这种奖励机制与控制理论中的反馈机制十分相似,而且深度强化学习具有自学习的能力,无需依赖过程模型,能够在与环境的交互中自主学得环境特征并做出决策.

近年来,不少研究人员在流程工业控制中引入深度强化学习,设计的强化学习控制器取得了良好的控制效果 [15-17] . 但是,由于神经网络的不可解释性,使得强化学习控制器只在一些仿真环境中进行了验证. 另一方面,由于实际工业过程中绝大部分控制回路都使用PID控制器,而由人工调整PID参数的过程与深度强化学习智能体与环境“试错”交互来学习最优策略的过程极为相似,这也为PID控制器参数优化提供了新的解决方案.

相较于智能优化方法,深度强化学习在PID参数优化中具有以下两个方面的优势: 第一,启发式的智能优化方法依赖对象的精确模型,而在工业过程中,往往只能获得对象的近似模型,这使得该类方法无法取得最优效果. 而由于深度强化学习是一种无模型的学习方法,尽管在实际实现时也需要进行对象模型的辨识,但其对模型精确度的依赖并没有智能优化方法那么高; 第二,智能优化方法对初始种群的选择十分敏感,在优化初期得到的PID参数造成的控制效果都是发散的,使得该方法在理论上都无法进行在线优化. 而强化学习方法则能在奖励函数的引导下,通过有限次的迭代进行逐步寻优. 因此,近年来,一些研究人员将深度强化学习引入到优化 PID 控制器参数的问题中. Shuprajhaa等人 [18] 将改进的PPO算法与PID控制器相结合,智能体通过每一步改变PID控制器的参数来实现控制. Tufenkci等人 [19] 利用确定性策略梯度算法整定电机的PI参数,并在Simulink环境中验证了其可行性. Liang等人 [20] 基于TD3算法提出了PID参数自整定算法,并在两轮直立车进行了验证. Chowdhury等人 [21] 将TD3 算法与软演员–评论家(soft actor-critic,SAC)算法相结合,提出了一种自适应PID控制方法.

但是,以DDPG,TD3为代表的确定性策略梯度算法是off-policy的深度强化学习算法,其训练时需要随机从经验回放池中采样样本来训练Critic网络,无法充分利用对网络更新作用更大的样本,易造成Critic网络更新不稳定,导致算法前期的优化效果不佳. 而体现在PID参数优化上的结果就是控制器的控制作用发散. 对于控制过程而言,控制作用发散无论是在真实对象还是仿真对象上都是绝对不允许的. 对于强化学习而言,在交互过程中控制作用发散意味着会获得大量的无效样本,这些样本会减缓智能体的学习,甚至破坏神经网络的训练. 因此,需要改进深度强化学习算法来提升前期的优化性能.

为了提升强化学习的学习效率,国内外研究人员针对经验回放机制进行了改进. Schaul等人 [22] 提出了优先经验回放机制,在网络更新时根据优先级进行采样. 该机制虽然能够提升效率,但是却引入了极大的计算开销. Zhang等人 [23] 提出了一种基于情节经验回放的强化学习方法,根据每个情节(Episode)的累计奖励来对样本进行分类,进而实现网络更新. Fan等人 [24] 在DDPG算法的基础上提出了基于多重指数移动平均评估的DDPG算法,该算法根据设定的阈值分别从两个经验回放池采样不同数据,但阈值的选择依赖经验. 由此可见,通过改进经验回放机制来采样更多有利于神经网络更新的样本,能够有效提升深度强化学习训练的效率.

针对上述问题,本文引入分类经验回放机制,提出了基于双经验回放池TD3 算法(TD3 with double replay buffer,DRB-TD3)的PID参数优化方法. 与文献 [18] 和文献 [20] 获得的自适应PID控制策略(控制器参数在每一个控制步都会变化)不同,本文方法能够直接获得整定好的PID参数,应用范围更加广泛. 此外,与文献 [19] 相比,本文进一步引入了双经验回放池,提升了神经网络的训练效率. 在加快奖励函数收敛的同时能够有效避免控制曲线的发散. 本文的具体工作如下: 首先使用 TD3算法训练 Critic(评价)网络和 Actor(策略)网络,Actor 网络输出直接用来控制被控对象; 针对Critic网络训练前期效率低的问题,引入双经验回放池: 将样本分为两部分,从TD误差更大的样本池中采样更多数据. 在训练时通过动态维护TD误差的均值,提升Critic网络的拟合效率,使得PID参数在线优化时更为稳定. 最后以二阶和一阶加纯时滞系统为仿真对象,并与PSO算法优化PID参数的方法进行对比,验证了所提方法的可行性,且所提方法要优于PSO算法.

2 深度强化学习

2.1 TD3算法

TD3算法是一种基于Actor-Critic架构 [25] 的深度确定性策略梯度算法. 在该架构中,通过最小化TD误差来训练Critic网络,其参数迭代公式如式(1)所示:

(1)

(2)

其中: ωt表示Critic网络的参数,αω表示Critic网络的学习率,δt为式(2)所示的TD误差,Qω表示被ω参数化的Critic网络,γ表示折扣因子,rt表示即时奖励.

根据最大化当前步累积回报的思想来训练Actor 网络. 其参数迭代公式如式(3)所示:

(3)

其中:表示Actor网络的参数,表示 Actor网络的学习率,表示被参数化的Actor网络.

TD3算法则在Actor-Critic网络架构下主要做了如下3点的改进,以增加整个网络训练的稳定性:

1)截断双Q网络训练: 在TD3算法中引入双Q网络,在计算TD误差时,使用两个Q网络中最小的网络输出值作为TD误差中的目标项,这能够有效地抑制Q 值高估的现象,如式(4)所示:

(4)

2)延迟更新: TD3算法使用一种延迟更新策略,即 Actor网络的更新频率设置得比Critic要慢,从而缓解 Critic网络频繁更新给Actor网络带来的训练不稳定;

3)目标策略平滑: TD3算法在目标动作中加入一定范围内的噪声(如式(5)所示),通过平滑Q函数沿着不同动作的变化,使得当Q函数未完全拟合时,策略更新能够更加地稳定.

(5)

式中:为目标动作,为目标Actor网络,c为截断区域大小.

这3方面的改进使得 TD3在训练稳定性上相较于DDPG有了显著提升.

2.2 分类经验回放机制

基本的TD3算法在每次更新时都从经验回放区随机采样批量样本用于网络训练. 对于深度强化学习而言,其网络训练没有固定的标签值,而是以TD误差最小化为准则来训练网络. 因此,不同类别的样本在网络参数优化时具有不同的影响.

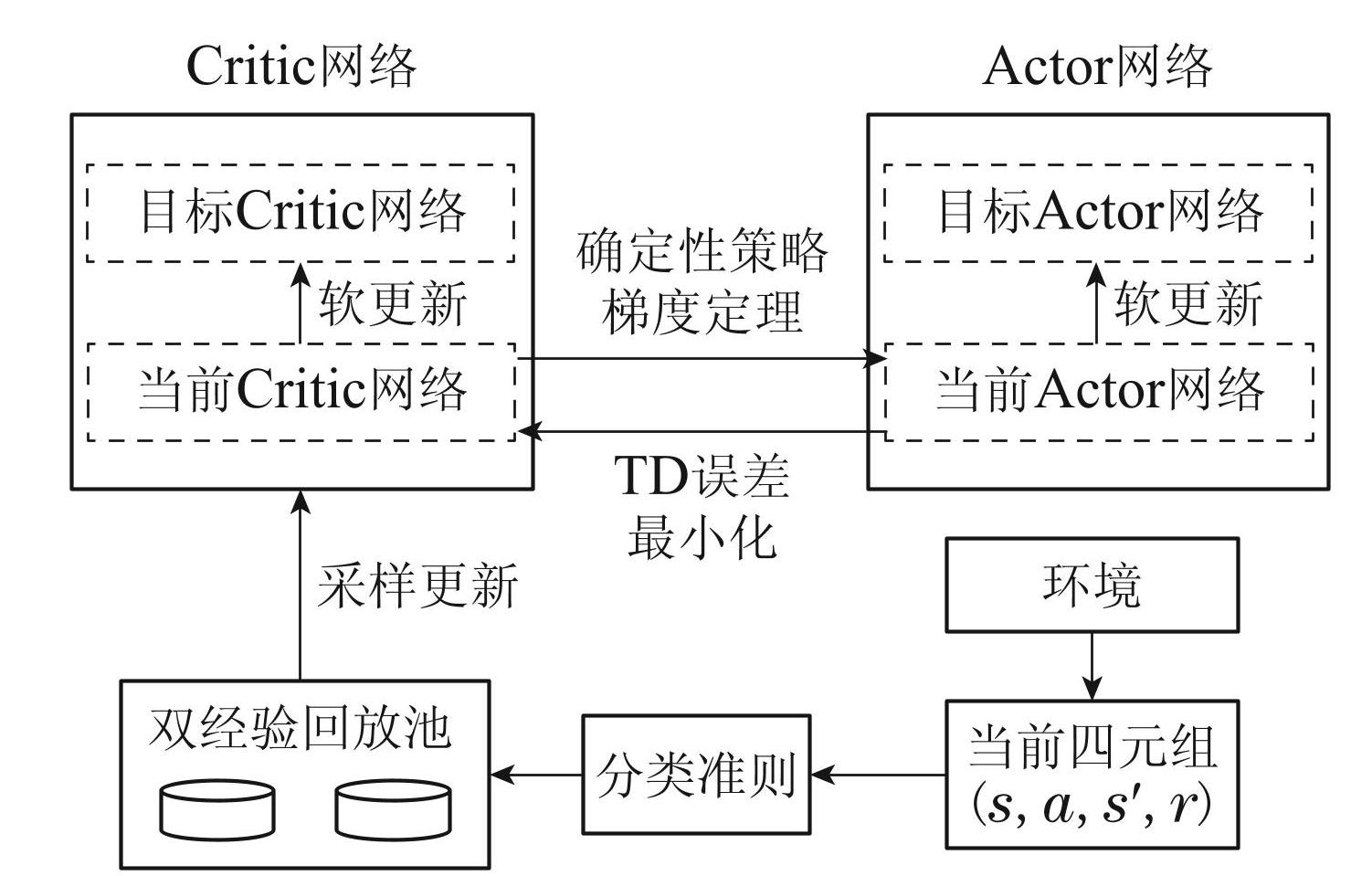

当以随机采样的方式从经验回放区采样时,会得到大量的普通样本,这导致网络训练的效率不高,且无法提升网络的泛化性能. 针对上述问题,本文引入分类经验回放,通过动态维护TD误差的均值,根据TD 误差将当前策略采样得到的样本分为两类: 将TD误差大于平均值的样本归为第1类,它们对于网络训练作用更大,采样时需采取更多第1类样本; 将TD误差小于平均值的样本归为第2类,其对于网络训练作用较小,采样时需减少对该样本的采样. 双经验回放池 TD3(DRB-TD3)算法的示意图与伪代码如图1和表1所示.

图1DRB-TD3算法示意图

Fig.1Schematic of DRB-TD3

结合图1来看,智能体在每一次和环境进行交互时,Actor网络根据当前状态s作出动作a,环境返回下一个状态以及即时奖励r. 此时根据当前四元组计算该四元组的TD误差,同时增量更新全局的TD误差均值. 并将该四元组的TD误差与全局的TD 误差均值进行比较,若其大于TD误差均值,则将其放入第1类经验回放池; 反之,则将其存放入第2类经验回放池. 在采样更新时,智能体从第1类经验回放池中采样更多的四元组来更新Critic 网络,Actor网络则依据确定性策略梯度定理来进行参数更新.

3 基于DRB-TD3算法的PID参数优化方法

3.1 PID控制

PID算法在连续域中的表达式如式(7)所示,r(t)为参考值,y(t)为实际输出值,e(t)为差值:

(6)

(7)

在计算机控制中,需要将式(7)进行离散化操作,如式(8)所示:

(8)

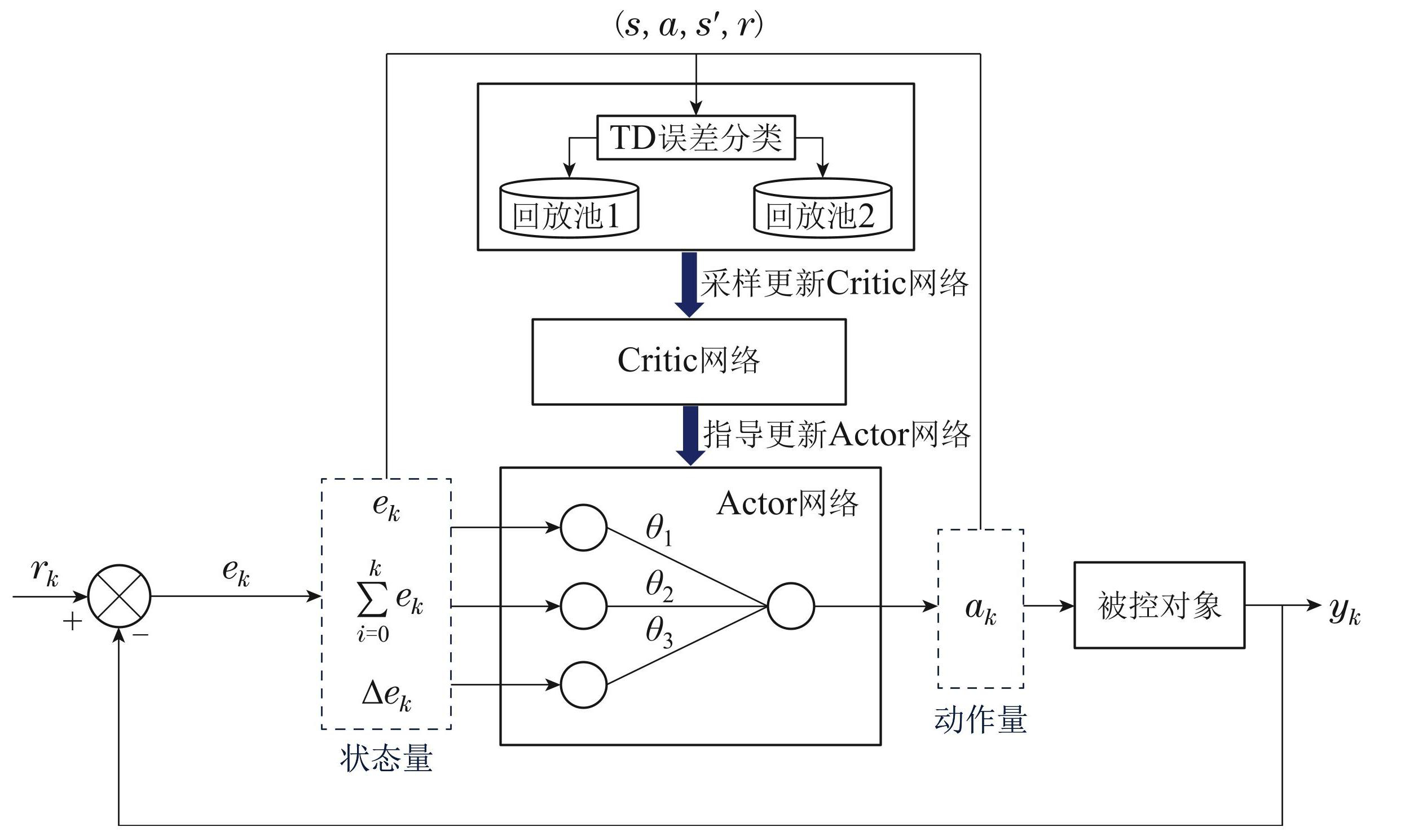

针对离散型位置式PID控制器设计的参数优化方法框架如图2所示.

表1算法1: DRB-TD3算法

Table1Algorithm 1: DRB-TD3 algorithm

图2中,Actor 网络的3个权值即对应PID控制器 KP,KI,KD 3个参数. 训练过程中,Critic网络指导 PID参数更新. 强化学习控制器根据偏差来输出控制量对过程进行控制. 需要注意的是,在实际过程中,对象可能不允许通过不断的试错来对控制器参数进行调整. 对于该类对象,可以考虑采用一个仿真对象或者孪生对象进行交互,待PID参数优化后,再将优化后的参数下装至控制器. 此外,出于安全性的考量,在智能体和对象交互时,需要对控制器的输出进行限幅.

3.2 Agent观测量和动作量设置

为了使Actor网络拟合PID控制律,设计Agent的观测量为当前时刻系统输出的偏差、偏差的累积量以及偏差的变化量,如式(9)所示:

(9)

同时设计Actor网络输出a为3个观测量的线性组合,即网络结构为不含隐藏层、不含激活函数的一层神经网络. 当Agent执行控制作用时,Actor的3个网络参数就分别对应着比例、积分以及微分系数. 训练时,Actor网络参数能够由策略梯度定理自动地进行调整,即对应PID控制器的3个参数朝着每次控制序列累计奖励最大化的方向进行调整. 实际应用时,不同被控变量的工程上限和下限不同. 因此在设计观测量和动作量之前首先需要将不同被控变量和控制变量(如温度、压力、流量等)进行标准化操作,而后再进行PID 参数的优化.

3.3 Agent奖励设置

使用智能优化算法整定PID参数时,将每一组PID 参数作为一个个体,将该组参数下所获得的阶跃响应的积分绝对误差(integral absolute error,IAE)指标作为个体的适应度值,如式(10)所示:

(10)

与IAE指标类似,式(11)为本文的奖励函数,即

(11)

式中: 第1部分为第k个时刻参考值与系统输出值偏差绝对值的负值,第2部分为第k个时刻控制器输出变化量绝对值的负值. 如果智能体的动作变化量不大且能明显缩小系统输出值的偏差,那么它就会得到一个较大的奖励,从而引导智能体的训练.

3.4 训练过程PID参数变化规律

训练过程中PID参数的变化即对应强化学习Agent中Actor网络参数值的变化. Actor网络的参数向量如式(12)所示:

(12)

Actor网络的输出则可以写成式(13)的形式:

(13)

结合式(3)和式(13)可以得到如式(14)所示的PID 参数变化率:

(14)

4 仿真实验

为了验证基于DRB-TD3算法的PID参数优化方法的效果,分别以二阶系统和一阶加纯时滞(first order plus delay time,FOPDT)系统为对象进行仿真实验,并与基于PSO算法的PID参数优化方法进行对比.

图2基于DRB-TD3的PID参数优化框架

Fig.2Framework for optimizing PID parameters based on DRB-TD3

4.1 仿真实验设置

实验基于Python 语言,硬件配置为 Apple M2Pro CPU 3.6 GHz,RAM 16 GB. 智能体训练轮次(episode)为1000轮. 二阶系统每轮次仿真时间设定为28 s,采样间隔为0.2 s. FOPDT系统每轮次仿真时间设定为80 s,采样间隔为0.5 s. 激励信号采用幅值为1的阶跃信号. PSO的适应值函数与强化学习Agent的奖励函数一致,如式(15)所示. 实验参数设置如表2所示.

(15)

表2仿真实验具体参数设置

Table2Parameter setting for simulation experiments

4.2 二阶系统仿真实验

二阶系统仿真对象的传递函数如式(16)所示:

(16)

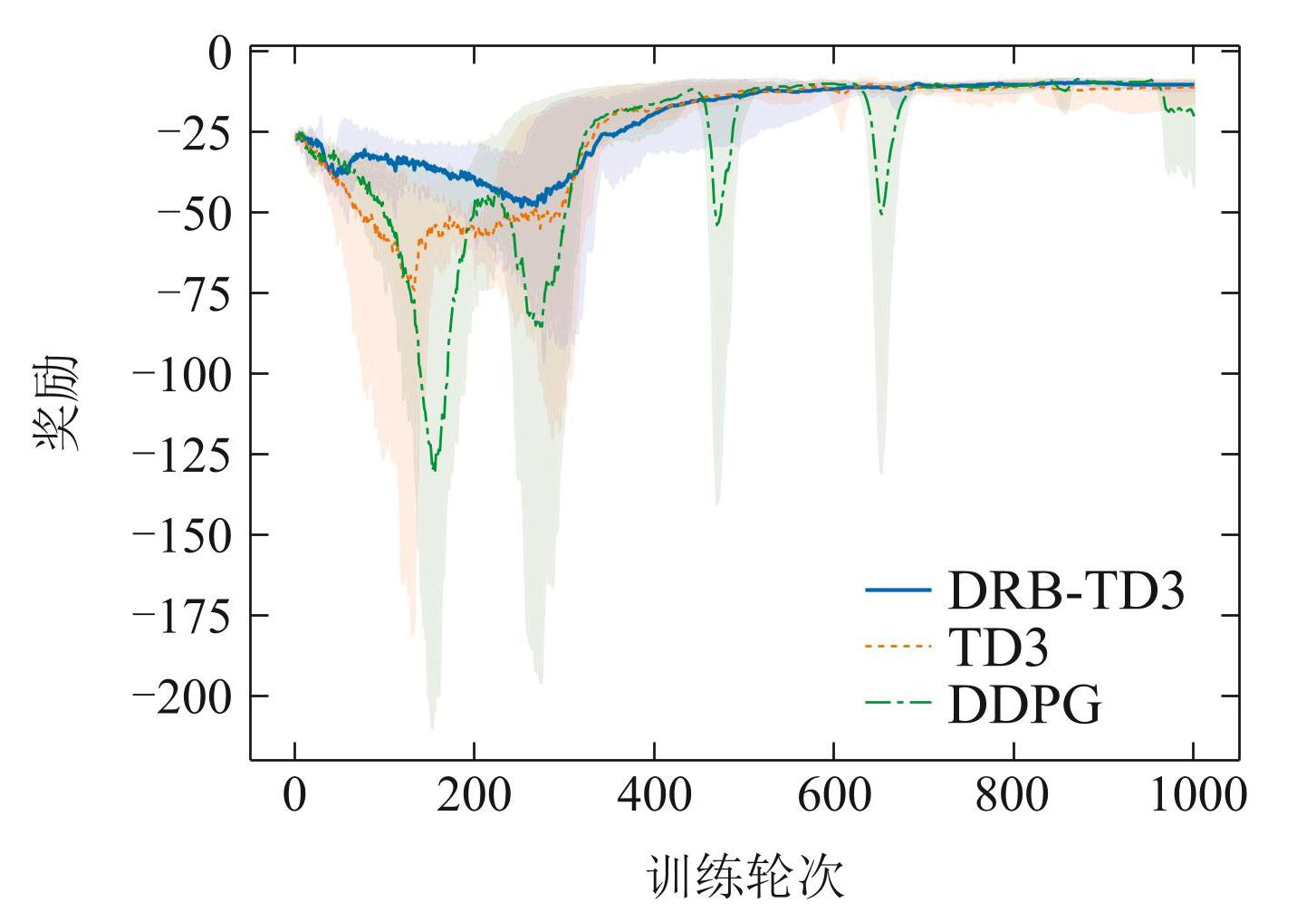

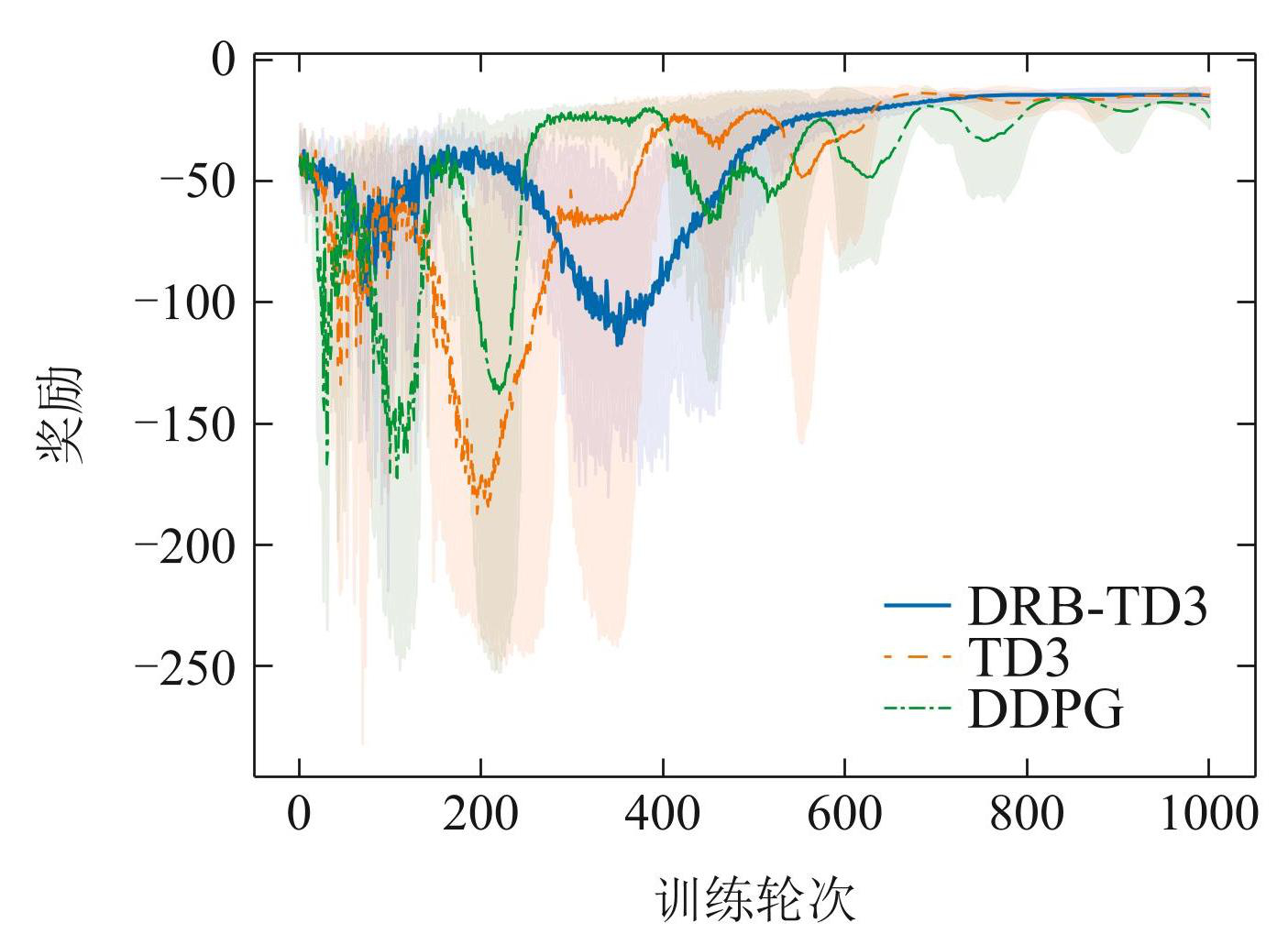

图3对比了 DRB-TD3算法、常规 TD3算法以及 DDPG算法在5个随机数种子下的训练奖励. 从中可以看出,DDPG算法虽然最终的奖励曲线不断地上升并收敛,但是其训练过程不稳定,存在多次波动. 其综合效果不如TD3以及DRB-TD3算法. 加入了双经验回放区之后,DRB-TD3的训练曲线在起始探索阶段的平均回报值要高于常规TD3算法的训练曲线. 这是由于引入双经验回放区后,在训练前期改变了每次更新 Critic网络的采样分布,即对网络训练作用更大的样本的采样次数要多于普通样本的采样次数,使得每个批次采样得到的样本更有利于拟合Critic网络,从而更好地引导Actor网络进行策略更新.

图3训练曲线对比图(二阶系统)

Fig.3Training reward curve comparison (Second order system)

图4为二阶系统每100个episode的系统输出曲线. 由于强化学习Agent在训练前期需要对环境进行探索,对于控制任务而言,Agent需要在动作输出噪声的作用下对系统特性进行探索. 因此,在前300个episode 时,系统的输出曲线并没有太多变化,整个曲线具有轻微的震荡,不同的震荡模态反应了系统特性. 此时尽管系统输出没有发散,但是其动态性较差,调节时间较长. 在300个episode后,由于Agent的Critic网络已经基本拟合完成,此时Critic网络已经能够比较准确地拟合当前状态下做出某个动作的价值,Actor网络随即能够根据拟合好的Critic网络朝着回报最大化的方向进行策略优化. 因此,此时系统的控制输出的动态性能有了很大的提升. 在随后的episode中,系统的控制输出曲线有微小的变化,但都保持了良好的控制性能. 尽管 500个episode 之后 DRB-TD3和TD3算法所对应的系统控制输出曲线差别不大,但是在前300个episode中,TD3所对应的系统控制输出曲线的发散程度要明显大于DRB-TD3. 这是因为DRB-TD3在训练前期能够根据样本的TD误差来选用更多有助于Critic网络拟合的样本进行更新,提高了Critic 网络的泛化能力,一旦策略在某些状态探索到了一些未知动作,Critic网络也能够及时地拟合这些未知的状态–动作对的价值,指导Actor网络更新,有效缓解了智能体在与环境交互过程中控制曲线的发散.

图4训练过程输出曲线变化图(二阶系统)

Fig.4Output curves during training process (Second order system)

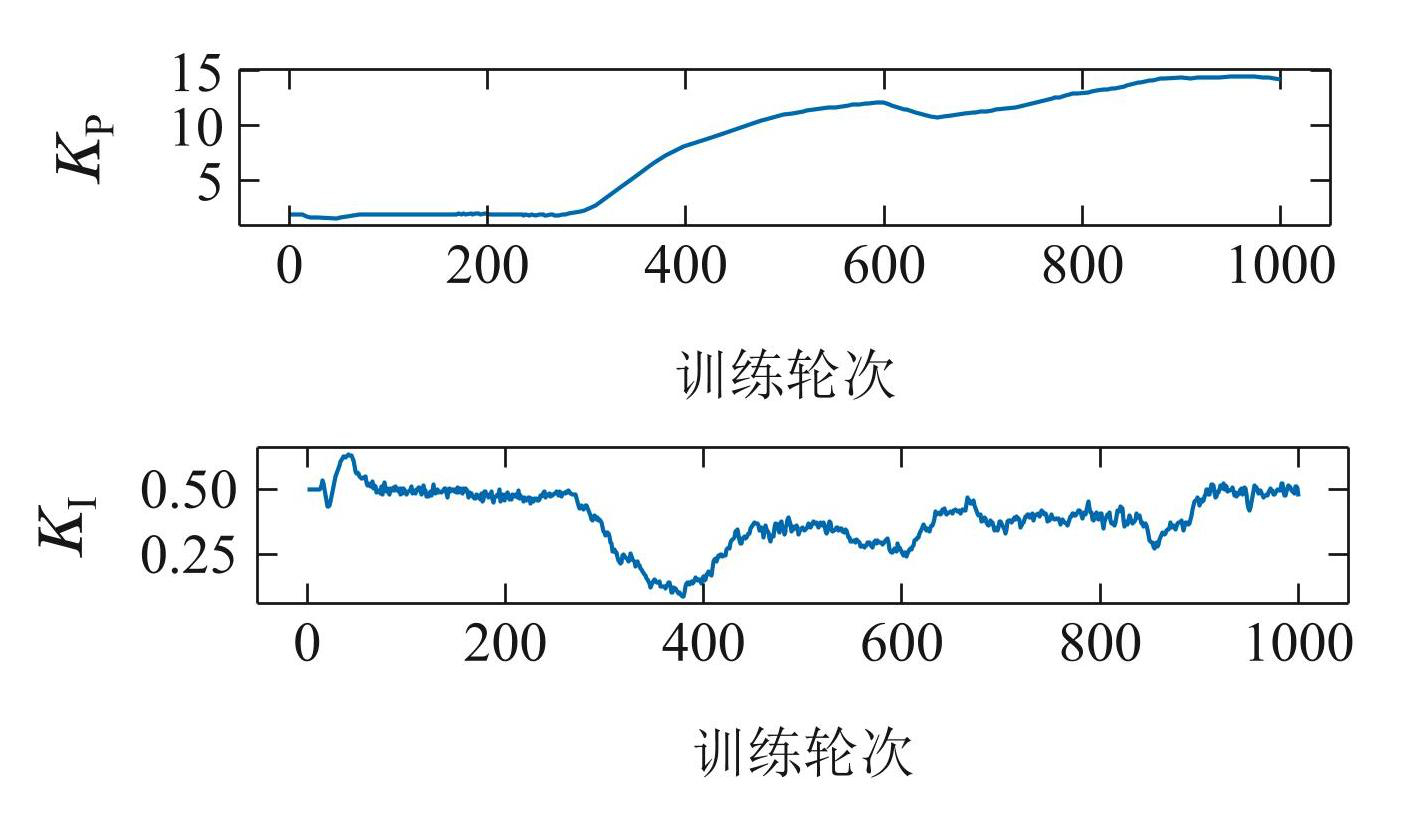

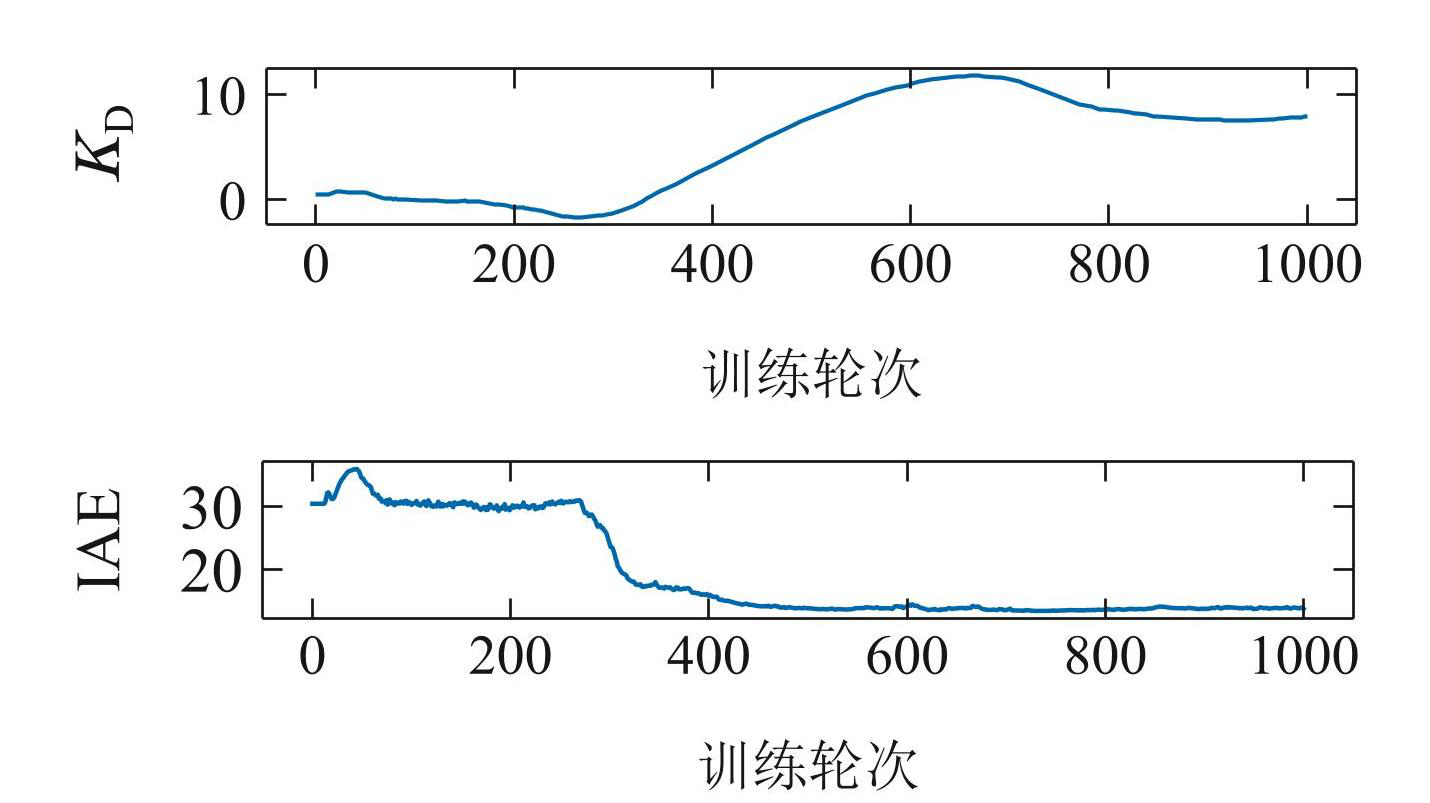

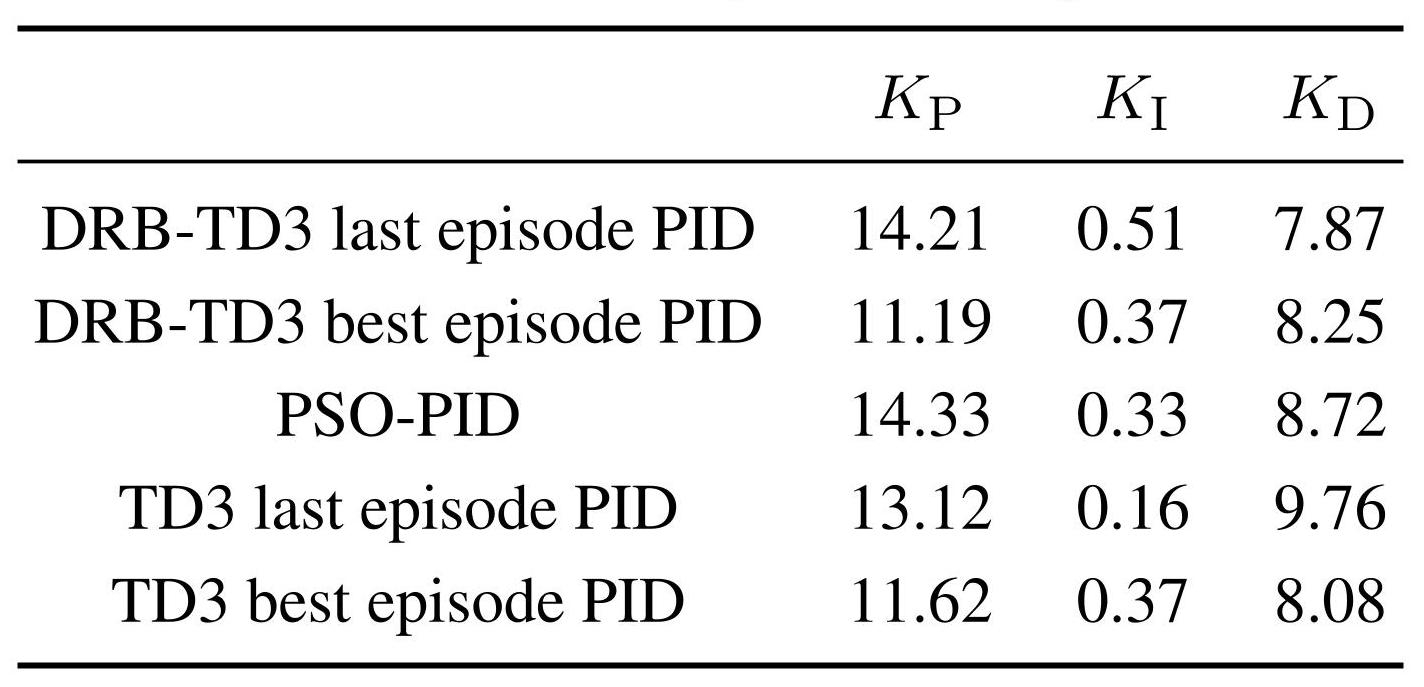

图5为DRB-TD3算法下整个训练过程PID 参数的变化曲线. 表3所示为 DRB-TD3 算法和 TD3 算法整个训练过程中最后一个episode(Last-episode-PID)、总奖励最高的episode(Best-episode-PID)以及PSO 算法(PSO-PID)优化得到的PID参数.

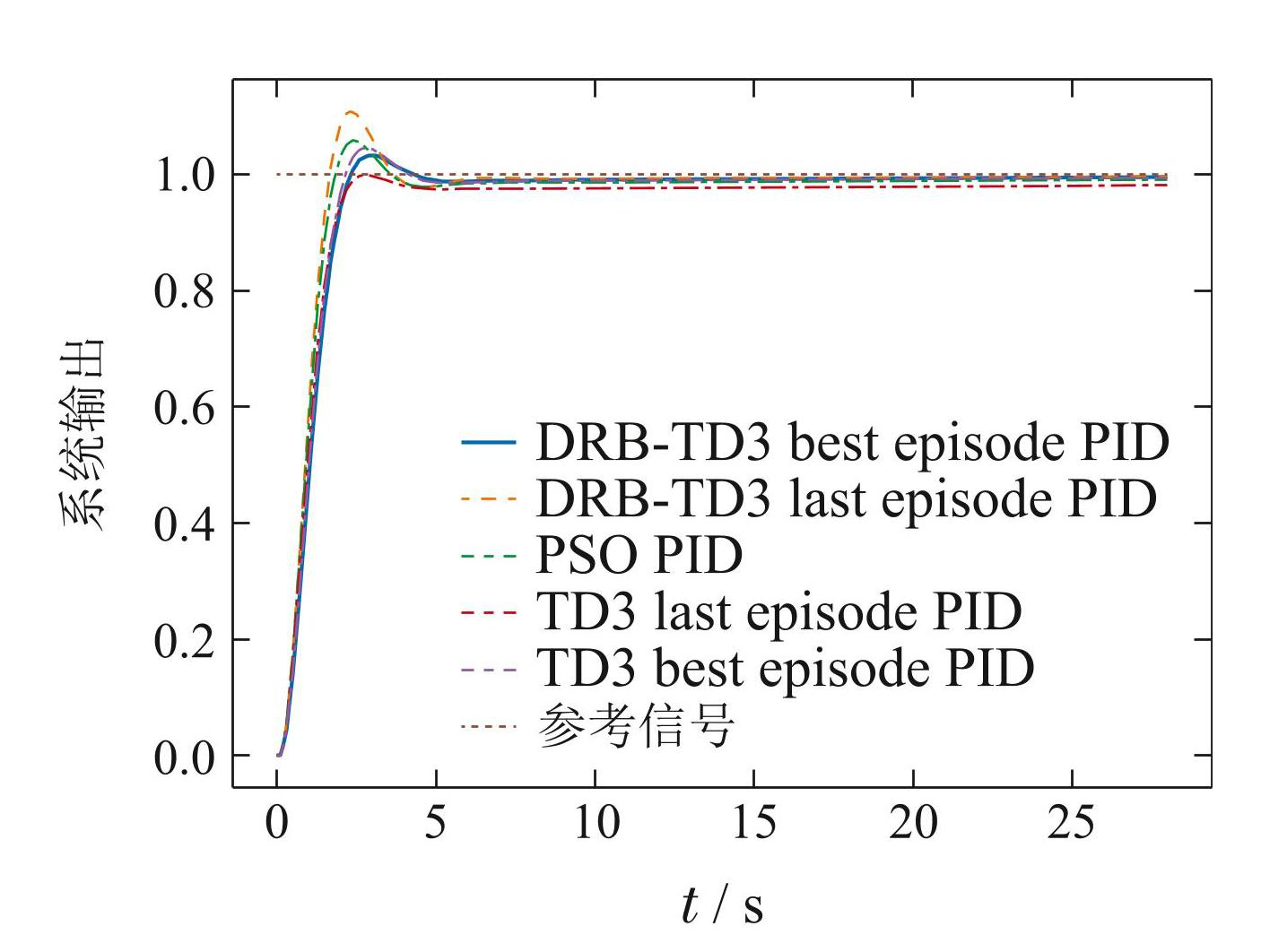

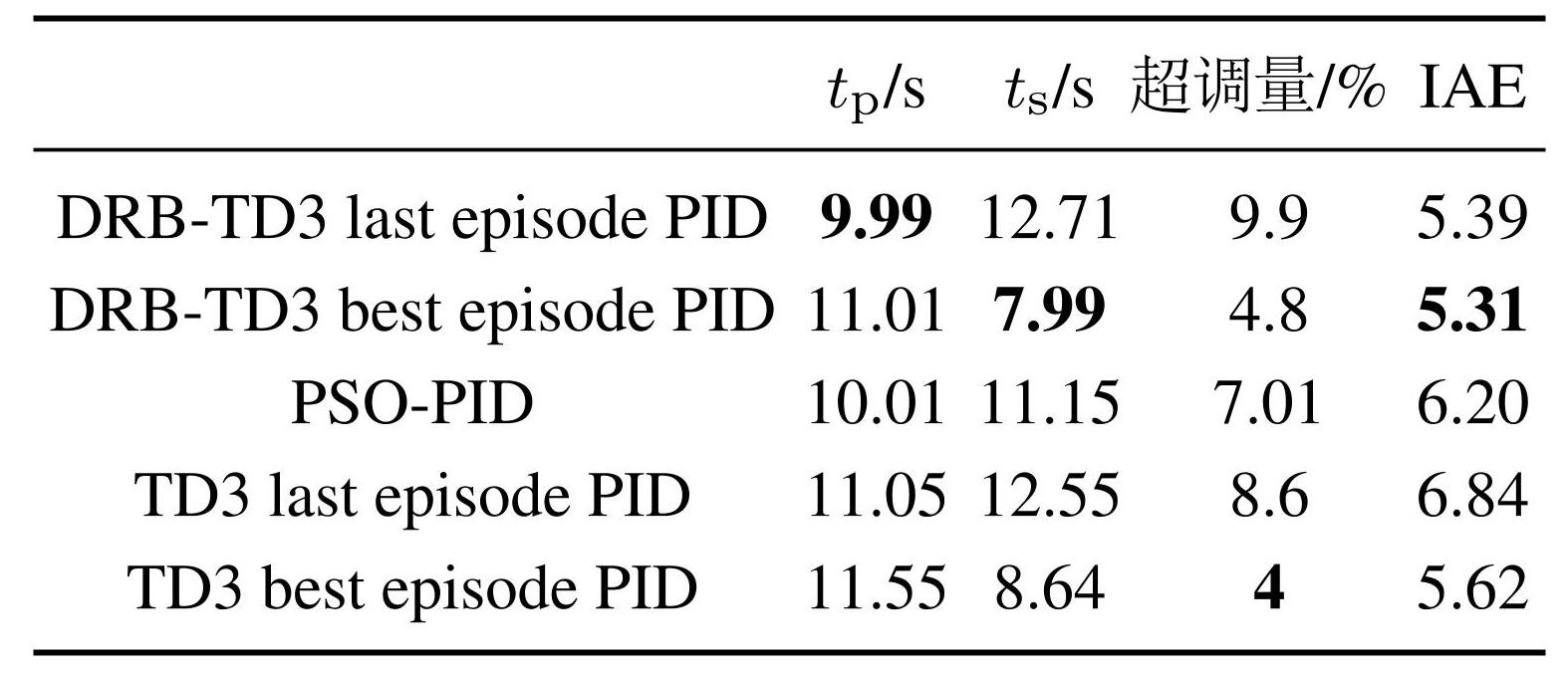

图6为表3所示的二阶系统的5种PID控制器参数的阶跃响应对比图,表4为对应的各项控制指标.

图5DRB-TD3算法训练过程PID控制器参数变化(二阶系统)

Fig.5PID parameters changing trend under DRB-TD3 (Second order system)

结合图6和表4可以看出,DRB-TD3的Last episode PID 在峰值时间和IAE指标上是最优的,系统输出有很好的快速性,但由于其对应的比例常数 KP 较大,导致了较大的超调. DRB-TD3和TD3 的Best episodePID较为相近,在调节时间以及超调量方面要远优于其他3组PID参数,系统输出具有很好的动态性,且其峰值时间和IAE指标也要优于PSO算法所获得的PID 参数. 综合来看,两种强化学习算法得到的Best episode PID所对应的PID参数是最优的. 综合图3–5来看,DRB-TD3的奖励函数在经过前期的探索后,奖励值逐步上升,在500个episode后就逐渐收敛. 从图4–5可以看出,尽管PID参数在后期略有变化,但是不同的PID 控制器参数所对应的控制效果基本相同,动态性能较好,且IAE指标也在奖励函数的引导下逐步减小,也最终收敛.

表3二阶系统PID参数表

Table3Second order system PID parameters

图6二阶系统PID控制阶跃响应对比图

Fig.6PID control step response comparison (Second order system)

表4二阶系统阶跃响应控制性能指标对比表

Table4Second order system step response control performance index comparison

值得注意的是,表4中TD3算法的Last-episode PID 在调节时间ts以及超调量Oversheet上要略优于DRBTD3算法的Last-episode PID. 但是从峰值时间tp以及 IAE指标来看,DRB-TD3算法要优于 TD3 算法. 从强化学习的角度来看,式(11)所示奖励函数的主要目标是最小化偏差的绝对值,即控制曲线的IAE指标. 而 DRB-TD3算法所获得的PID参数的控制曲线的IAE指标要优于TD3算法. 强化学习智能体在奖励函数最大化的指导下,自主平衡了各个动态性能指标,最终总体的控制曲线性能差异不大.

4.3 一阶加纯时滞(FOPDT)系统仿真实验

FOPDT系统仿真对象的传递函数如式(17)所示:

(17)

图7所示为 DDPG、常规 TD3与DRB-TD3算法的训练曲线对比图(一阶加纯时滞系统).

图7训练曲线对比图(一阶加纯时滞系统)

Fig.7Training reward curves comparison (First order plus delay time system)

从图7中可以看出,DDPG算法的训练曲线在整个过程中存在多次波动,其算法训练较不稳定且其后期奖励也要低于 TD3和DRB-TD3算法. DRB-TD3算法的最差综合奖励值要高于常规TD3算法的最差综合奖励. 对比图3和图7,可以发现在整个训练过程中,奖励曲线都呈现一种先下降再上升的趋势,其原因一方面是由于强化学习方法本身的探索特性; 另一方面则是由于PID控制的特点: 在参数优化过程中,PID参数是连续变化的,当PID 3个参数从初始参数向较优参数演化时,不可避免地会触及一些较差的PID参数,从而降低控制器的控制性能(如图5与图9中IAE指标的变化曲线所示). 对于带有时滞的系统,其能够保证系统输出不发散的 PID参数区域相较于二阶系统更小,如果Critic网络拟合效率不高,没有及时修正Agent的输出,则得到的PID参数会越来越差. 因此,通过双经验回放池来提高 Critic网络的拟合效率,从而引导Actor 网络进行有效地更新十分重要.

图8为FOPDT系统训练过程输出曲线变化图. 从中可以看出,由于式(17)所示的一阶纯时滞对象的可用PID参数范围相较于式(16)所示的二阶对象更小,因此,无论是强化学习方法还是智能优化方法,其训练过程的曲线都有震荡的趋势. 但是,PSO 算法对应的系统输出曲线前期的震荡更加剧烈,这是因为这类基于启发式的智能优化算法在初始阶段会随机初始化一系列个体,通过求解每一个个体的适应度值来找到最优个体,而在优化PID控制器参数时,无法保证每个个体所对应的PID控制效果都能达到要求.

图8训练过程输出曲线变化图(一阶加纯时滞系统)

Fig.8Output curves during training process (First order plus delay time system)

从TD3和DRB-TD3 的对比中可以看出,在前400 个episode,系统输出曲线的控制效果较差,处于从初始参数向较优参数的过渡阶段. 在400个episode 后,此时系统输出的动态性能有了很大的提升,控制曲线的震荡减小,超调减小. 在最后的几个episode中,系统的控制输出曲线都保持了良好的控制性能,尤其是 DRB-TD3算法,在最后几个episode 中控制曲线十分稳定,几乎没有太多的变化.

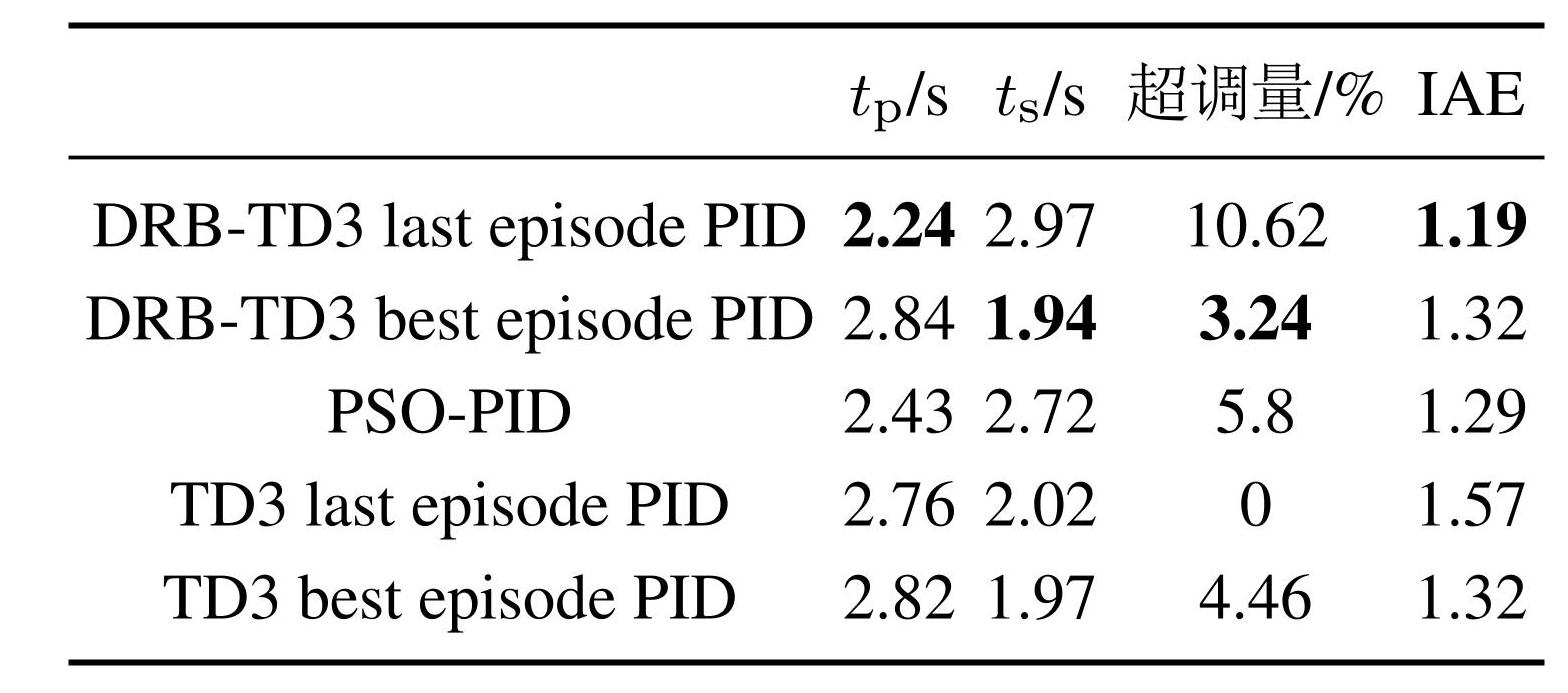

表5是式(17)所示一阶纯时滞系统最终所整定的 PID控制器的阶跃响应控制性能指标对比表. 从中可以看出,对于FOPDT系统,DRB-TD3 的Last episodePID在峰值时间是最优的,IAE指标次优,系统输出具有很好的快速性,但其控制曲线的超调量较大. DRBTD3的Best episode PID在调节时间以及IAE指标方面要优于其他4组PID参数,且超调量也是次优的,系统输出具有很好的动态性能. PSO算法所获得的PID参数与其他几组参数相差较大,其峰值时间较短. 综合来看,DRB-TD3算法得到的Best episode PID所对应的PID参数是最优的.

实际生产过程中,被控对象通常具有时变特性. 为了测试本文所提参数整定方法下PID控制器的控制性能,对式(17)所示的对象模型进行参数摄动实验. 对于FOPDT模型,时间常数T 的变化对系统影响较大.因此取T变化−10%,−20%,−30%,10%,20%,30%,相应系统的阶跃响应如图9所示.

表5一阶纯时滞系统阶跃响应控制性能指标对比表

Table5FOPDT system step response control performance index comparison

从图9可以看出,当T 增加时,系统阶跃响应曲线的差异不大. 然而,当T 分别降低 10%,20%,30%时,采用强化学习方法调优的 PID 控制器(尤其是 DRBTD3 的best episode PID和last episode PID)的性能明显优于PSO. 其中一个原因是强化学习在训练时通过在动作输出中添加一定量的噪声来探索环境. 该噪声使得随机性被添加到交互环境中,即强化学习不需要依赖于精确的对象模型. 因此,这些噪声使得控制水平更加鲁棒. 粒子群算法依赖于精确模型,一旦模型参数发生变化,其整定的PID参数的控制性能难以保证,鲁棒性较差.

图9模型失配时的阶跃响应图

Fig.9Step response with model mismatch

5 总结

本文提出了一种基于双经验回放池TD3算法的 PID参数优化方法. 在TD3算法的基础上,增加了双经验回放池机制,采样更新时选择更多有利于策略网络参数更新的样本进行策略迭代,提升了算法在PID参数前期学习时的效率,有效避免了学习过程中系统输出的发散. 最后,通过实验验证了所提算法的可行性与有效性. 未来的工作考虑将深度强化学习方法进一步应用于时变对象的PID在线整定.