摘要

微电网能够组合运用源网荷储协调弥补分布式电源(DGs)出力不确定性的不足, 并在孤岛状态下最大程度保障用户的供电可靠性. 以孤立微电网为研究对象, 为解决一次下垂控制引起的电压频率偏差问题, 提出了一种基于深度强化学习的孤立微电网分布式牵制协同控制策略, 能够有效抑制负载扰动或系统拓扑结构变化时频率和电压的波动. 首先, 针对牵制一致性算法中牵制目标值难以准确预设和改变的问题, 采用深度强化学习算法中双重深度Q学习(DDQN)算法对牵制目标值进行自适应修正, 利用DDQN的适应性以及泛化能力, 提升牵制一致性算法的适应性和有效性; 其次, 设计了基于DDQN的牵制控制器结构, 并完成了状态空间、动作空间和奖励函数的定义; 最后, 仿真结果表明, 所提控制方法与传统的牵制控制和基于强化学习的牵制控制相比, 在抑制频率电压波动方面更具优势, 并且能更好的适应系统网络拓扑参数和结构的变化.

Abstract

Microgrids can comprehensively utilize various energy sources and coordinate energy storage systems to compensate for the uncertainties in the output of distributed generators (DGs). a distributed pinning collaborative control strategy based on deep reinforcement learning for isolated microgrids is proposed to solve the problem of voltage and frequency deviation caused by droop control in isolated microgrids, which can effectively suppress frequency and voltage fluctuations under load disturbance or system topology changes. Firstly, aiming at the problem that the pinning target value in the pinning consistency algorithm is difficult to accurately preset and change, the double deep Q learning (DDQN) is used to adaptively modify the pinning target value by leveraging the adaptability and generalization capability of DDQN. It improves the adaptability and effectiveness of the pinning consistency algorithm. Furthermore, the structure of the distributed pinning collaborative controller based on DDQN is designed, and the definition of state space, action space, and reward function is completed. Finally, Simulation results demonstrate that the proposed control method outperforms traditional pinning control and reinforcement learning-based pinning control in responding to changes in network topology parameters and structure.

1 引言

微电网随着分布式能源(distributed generators,DGs)的快速发展,已成为处理分布式能源并网问题的重要解决方案之一 [1-3] . 在孤岛运行模式下,通常由微型发电源和柔性负载来维持频率和电压的稳定. 然而,由于微电网缺乏大电网的支持,且容量和系统惯性时间常数较小,因此需要更加适用于微电网的控制方法,以实现微电网频率和电压的协调控制,并确保其的稳定性和可靠性.

传统的孤岛微电网控制方法主要有3种: 集中式控制、分布式控制和分散式控制 [4] . 但是集中式控制可靠性较差,且缺乏扩展的灵活性,分散式控制难以整体协调,因此近年来分布式系统结构被广泛应用于微电网控制领域 [5-7] . 然而,传统的分布式二次控制方法仍然存在着一些问题,例如受被控系统的参数变化影响较大、通信拓扑结构复杂、控制参数设计困难 [8-10] .

为了解决传统分布式二次控制存在的问题,文献 [11] 基于牵制控制的时间尺度和主要参数的主要特征,提出了牵制同步控制策略,文献 [12] 使用平均一致性算法,以分散的方式共享全局信息并执行频率控制策略,实现频率恢复. 文献 [13] 设计了一种基于牵制一致性的分布式控制器,能够比例调节频率和输出功率. 文献 [14-17] 将牵制控制引入到了微电网的控制中,能够在多种扰动下实现频率和电压的稳定. 以上方法通过牵制一致性算法使孤立微电网在仅相邻节点通信的条件下适应结构变化并且实现二次控制,但是由于牵制目标值难以准确预设和改变,导致孤立微电网状态变化的瞬间频率和电压具有一定的超调量,造成系统不稳定.

也有学者将智能控制算法应用于分布式二次控制中,文献 [18-19] 将强化学习应用于微电网的频率电压控制,实现了微电网频率电压的稳定. 但是当系统的拓扑结构发生变化时,会导致环境发生变化,从而引起控制性能下降.

为了进一步提高智能算法的泛化能力和自适应能力,文献 [20-21] 设计了基于深度强化学习的控制器,该控制器在微电网控制中具有良好的收敛特性和模型适应性. 文献 [22-23] 建立了一个包含多分布式能源、电动汽车和随机输出功率增量约束条件的孤微电网模型,设计深度强化学习(deep reinforcement learning,DRL)的频率控制器,以适应随机强干扰和拓扑参数改变. 文献 [24-25] 采用双重深度Q学习(double deep Q learning,DDQN)算法,采用经验重放和固定目标两种技术,避免了强化学习和DQN中过高估计的问题,提高了动作价值估计的准确性,以及控制精确性. 上述算法控制器通过引入额外约束和边界等方式来管理各分布式能源的输出. 然而,由于分布式电源的间歇性和不确定性,系统拓扑结构可能会出现意外变化. 需要采用更深层次的神经网络来适应微电网中分布式电源数量的增加所导致的控制复杂性.

针对牵制控制中牵制目标值难以准确预设和改变,以及深度强化学习神经网络维度随分布式电源数量增加而不断深化的问题,提出了一种基于深度强化学习的孤立微电网分布式牵制协同控制策略. 该策略利用深度强化学习算法自适应修正牵制目标值,提高了牵制目标值的准确性,减少了频率电压的波动率; 通过牵制一致性算法实现所有分布式电源的全局协同,避免了神经网络深度随分布式电源数量而改变.

2 基础算法理论

2.1 牵制一致性算法

分布式牵制控制是利用局部控制和耦合关联趋同控制解决复杂网络全局控制问题的有效方法之一,对复杂网络中部分关键节点施加牵制控制,发挥节点之间耦合关联的趋同作用,实现复杂网络中所有节点的全局协同 [5] .

各智能体除了需要实现与相邻节点间的信息交互,还将跟踪牵制点的信息状态,将牵制值应用于系统的状态方程中,则牵制一致算法的表达式为

(1)

式中: xij表示节点i和j之间的连接权重系数, xi和xj 分别表示节点i和j之间的本地信息,Ni表示与节点i 相邻的节点集合,ci表示牵制控制增益,xref表示牵制参考值. 定义节点状态和参考值的偏差量为di ,即

(2)

则式(1)可以用偏差量描述成

(3)

则每个agent信息牵制过程表述为矩阵形式

(4)

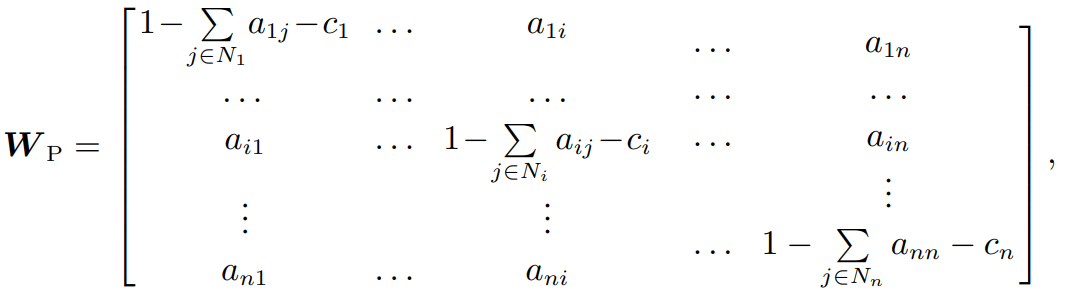

式中表示信息更新矩阵,其中各元素表达式为

(5)

当矩阵各行列的和为1 时,牵制一致性算法稳定.

2.2 深度强化学习算法

深度强化学习通常基于马尔可夫决策过程(Markov decision process,MDP),通过模拟环境来模拟智能体与环境的交互过程. 传统的MDP过程包括4个要素: 状态集合S、动作集合A、奖励函数R和策略集合 µ [25-26] . Q学习算法是通过更新式(6)来更新定义的Q函数.

(6)

式中: Q(s,a)为在状态s下采取动作a能够获得的期望回报,Q′为目标Q值,s ′是从状态s采取行动a后转移到的下一时刻状态, a ′为状态s ′下采取的动作,α为学习率,R为奖励值,γ为折扣因子. DQN使用深度神经网络代替了Q 值表,本文采用的是 DQN的改进版本: 双重深度学习算法(DDQN),DDQN 算法对DQN 算法进行了两点改进:

1)首先,引入了两个网络: 目标值网络和当前值网络. 减少目标Q值与当前值网络参数之间的依赖关系,避免了Q值过高估计的问题,提高了对动作价值估计的准确性;

2)DDQN算法解耦了式(6)中目标Q值的动作选择和目标Q值的计算过程,固定了目标Q值,增强了算法的稳定性[27] .

通过减轻高估计问题和增强稳定性,DDQN能够提供更可靠的动作选择策略,从而更快地收敛到较优解. 在经过离线学习后,面对未知的状态和动作空间时,DDQN更好地适应各种环境,并取得比传统方法更好的控制精度. DDQN通过从当前值网络中寻找最大Q值对应的动作,再放入目标值网络中计算目标Q 值

(7)

2.3 基于深度强化学习的牵制控制算法

基于上述算法原理,通过深度强化学习生成牵制目标值,并应用于牵制一致性算法的偏差矩阵中,实现偏差矩阵根据系统运行状态变化进行自适应调整,减少超调或欠调的现象,提升牵制一致性算法的适应性和有效性,基本控制流程如图1所示.

图1基于DDQN的牵制控制框图

Fig.1Block diagram of pinning control based on DDQN

DDQN通过牵制控制与环境进行交互,减少弱通信条件和网路结构变化带来的影响,只需要在定点更新神经网络,减少了离线计算训练的工作量和神经网络复杂度. 同时,可以通过对牵制矩阵的修改来更好的适应电源即插即用操作,提高系统扩展灵活性.

3 基于深度强化学习的微电网频率电压牵制控制

基于深度强化学习的微电网频率电压牵制控制结构如图2所示,微电网二次控制主要分为两个部分: 牵制目标生成和牵制控制.

图2控制结构

Fig.2Control structure

3.1 频率牵制目标值生成

在微电网二次频率控制中,应将系统实时的频率偏差|∆f|作为输入,|∆F(t)|作为频率控制器状态集,可将其定义为

(8)

根据中国电能质量及相关规定,电力系统在正常运行时,应将频率控制在 50±0.2 Hz之内 [28],设置 ∆F(t)为(−∞,0.2)Hz,[0.2,0.15)Hz,[0.15,0.1)Hz,[0.1,0.02)Hz,[0.02,0.02] Hz,(0.02,0.1] Hz,(0.1,0.15] Hz,(0.15,0.2] Hz,(0.2,+∞)Hz.

频率控制器的联合动作集A,即控制器的输出,即为二次频率控制值,故将动作空间定义为

(9)

式中AF 为频率控制器的动作值,取 = −0.1,−0.05,−0.01,−0.005,−0.001,0,0.001,0.005,0.01,0.05,0.1.

以频率恢复到额定值和牵制偏差最小为控制目标,将频率控制器的奖励函数设为

(10)

式中: rf为频率奖励; a为牵制控制偏差量对奖励值的影响系数,为各控制区域对应的奖励系数,通过大量的仿真研究,取µ = 0,5,15,20,40.

通过rf对频率进行调控,考虑一定的死区和微电网正常工作允许的频率波动,当处于调节死区 [0.02,0.02 ] Hz时,此时频率处于正常合格波动范围,频率控制器获得奖励值为0; 当处于其他状态区间时,频率偏移出合格波动范围,需要采取相应的动作抑制频率偏移并获得相应的奖励值.

3.2 电压牵制目标值生成

电压控制器的输入为 |∆u| 状态集为电压偏差 |∆U(t)|,状态空间可定义为

(11)

根据中国电能质量及相关规定,电力系统电压偏差应在 5%. 额定电压范围之内 [22],设计二次电压控制的离散状态集 ∆U(t)为(−∞,0.1)p.u.,[0.1,0.05)p.u.,[0.05,0.02)p.u.,[0.02,0.01)p.u.,[0.01,0.01] p.u.,(0.01,0.02] p.u.,(0.02,0.05] p.u.,(0.05,0.1] p.u.,(0.1,+∞)p.u..

电压控制器的联合动作集,即控制器的输出,即为二次电压控制值,故将动作空间定义为

(12)

式中 为频率控制器的动作值,取 = −0.08,−0.01,−0.005,−0.003,−0.001,0,0.001,0.003,0.005,0.01,0.08.

由于每个节点的电压值都不同,电压控制器的控制目标是将主牵制点的电压恢复到1.0 p.u.以及牵制控制偏差值最小. 由此,可以将电压控制器的奖励函数设为

(13)

式中: 为电压奖励; a为牵制控制偏差量对奖励值的影响系数,为各控制区域对应的奖励系数,通过大量的仿真研究,取δ = 0,5,15,20,40.

频率控制器和电压控制器的结构相同: 学习率 α = 0.01,折扣因子γ = 0.9,神经网络为隐藏层层数 h = 1,神经元个数u = 65的全连接层.

3.3 控制流程

首先,确定模型基本结构,确定神经网络参数和牵制信息矩阵,随机初始化当前值网络参数和目标值网络参数.

其次,按照式(7)在二次电压频率控制时选取贪婪动作

(14)

然后,采用牵制控制方法实施孤立微电网二次控制,定义偏差矩阵

(15)

依据牵制控制迭代式,计算得出第k + 1次牵制控制的动作值

(16)

计算出牵制动作值后,对应DG的二次相应调整值如下

(17)

在其余agent通过通信网络向牵制参考值靠拢后,获得奖励值r,按照式(18)为损失函数计算loss,并送入优化器中,对当前值网络的参数进行更新.

(18)

式中: yt为目标值网络得出的输出值,Q(st,at,θ)为当前值网络的输出值.

循环上述参数更新过程,直到完成模型收敛. 基于深度强化学习的牵制控制流程如图3所示. 将主agent 进行训练,其余agent通过通信耦合关系向主agent趋同,最终各DG实现频率和电压的稳定. 此外,采用以下两个指标描述频率稳定性:

1)频率波动率,即频率的标准差:

(19)

式中: σf为频率的标准差,n为DG的频率采样点总数,fi为DG采样点的频率值,f0 为参考频率值.

图3基于深度强化学习的牵制控制流程图

Fig.3Deep reinforcement learning based pinning control flow

2)频率的平均合格率:

(20)

式中: ρ 为频率的平均合格率; ρi, xi,ni 分别是各 DG 频率的合格率、合格总数、采样总数; N为DG的数量.

在每一幕的步骤为:

1)确定模型基本结构,确定神经网络参数和牵制信息矩阵,随机初始化当前值网络参数和目标值网络参数;

2)初始状态为s,根据贪婪控制策略,选择最优动作值;

3)然后使用牵制控制方法实现贪婪动作,牵制控制实施结束后,agent进入st+1状态,得到的奖励值 rt+1和新状态st+1,以a,s,r,s′的形式存入经验缓存区,根据式(17)为损失函数训练并更新当前值网络并且每隔一段时间目标值网络复制当前值网络;

4)判断s是否是最终状态,若是,循环结束; 若不是,则更新状态并返回步骤2).

4 算例验证

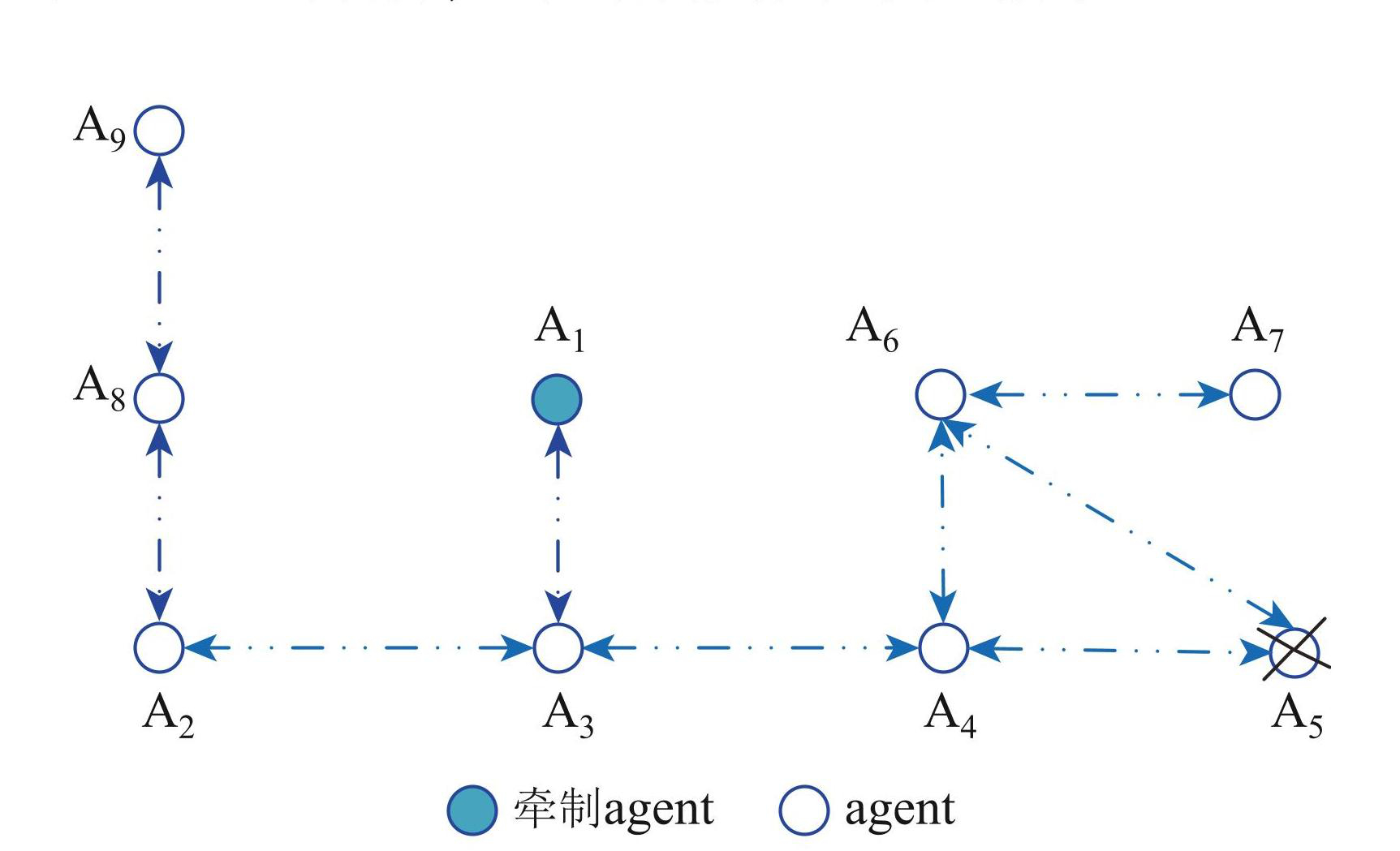

为了验证所提控制算法的正确性和有效性,基于欧盟微电网项目提出的典型低压微电网系统,在 MATLAB/simulink仿真平台搭建了如图4所示的微电网仿真模型 [29] . 微电网系统仅相邻节点通信,通过在不同的节点接入分布式电源、负荷等,形成多功率、多负载的低压微电网系统.

图4微电网模型图

Fig.4Microgrid model

在本例中,将DG1(A1)选取为牵制点,将分布式电源分别接入A1,A5,A6,A9. 微电网系统中各DG的下垂系数及系统主要参数如表1所示.

4.1 预学习阶段

在开始仿真之前,需要对控制器进行预学习训练,通过数据采集装置获取分布式电源的频率、电压等信息,存入数据库中; 采用离线学习模式,使智能体在预先收集好的数据中进行学习,使控制器不断的积累经验和智能决策能力,在进行了充分的离线学习后在边缘计算终端中应用,实现对分布式电源参与微电网调控的支撑,并通过数字化平台实现在线管控,进一步防止对电网产生较大的冲击.

表1微电网参数

Table1Microgrid parameters

仿真模型如图4所示,并在负载端加入正弦扰动,该扰动初始幅值为15 kW和10 kVar,在1.5 s后,幅值增大为30 kW和20 kVar.

将牵制控制器的电压牵制目标值设定为1.0 p.u.,功率牵制目标值设定为50 Hz,收敛系数ξ取0.85,牵制控制增益ci取0.85,其余agent向其搜寻同步.

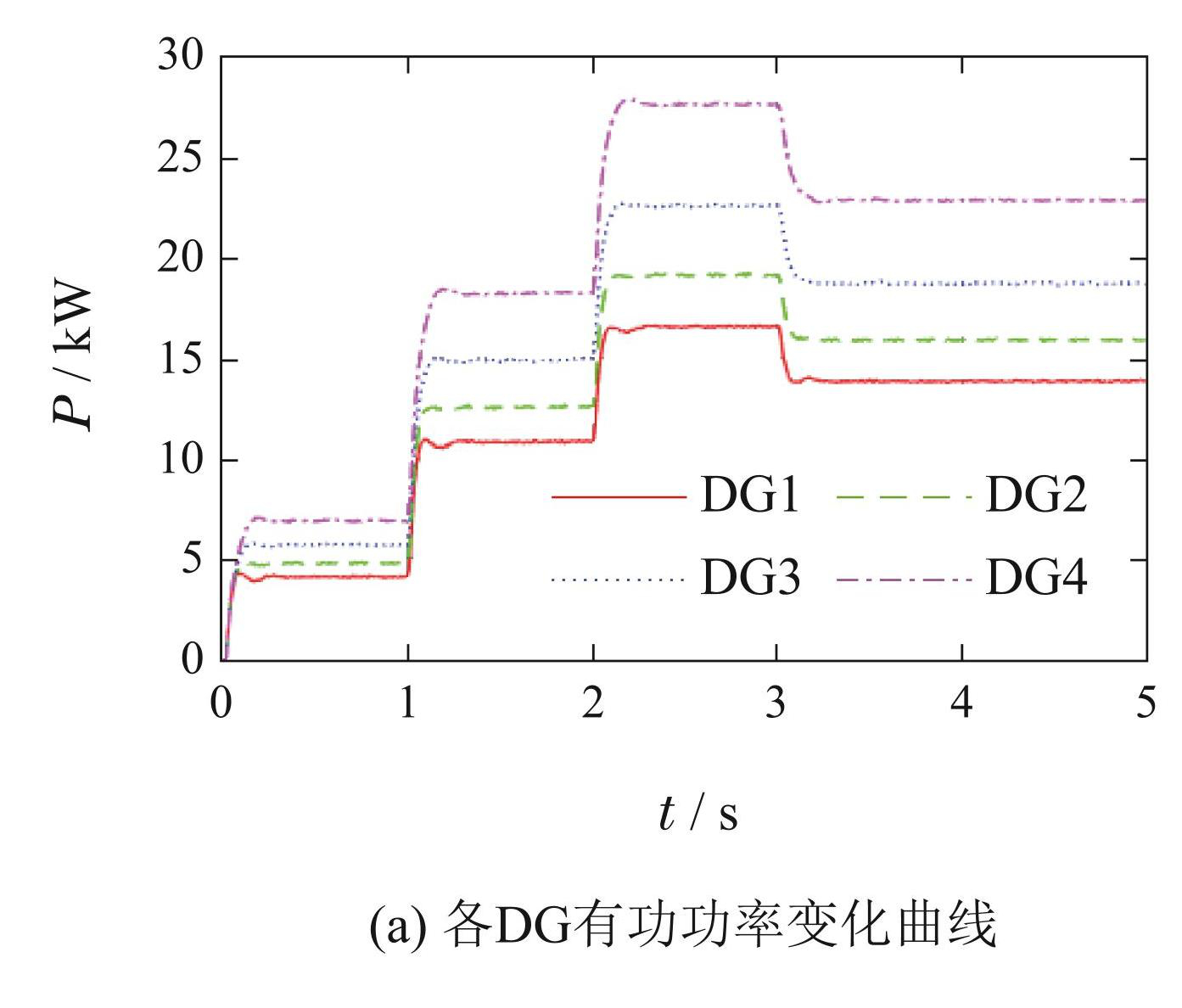

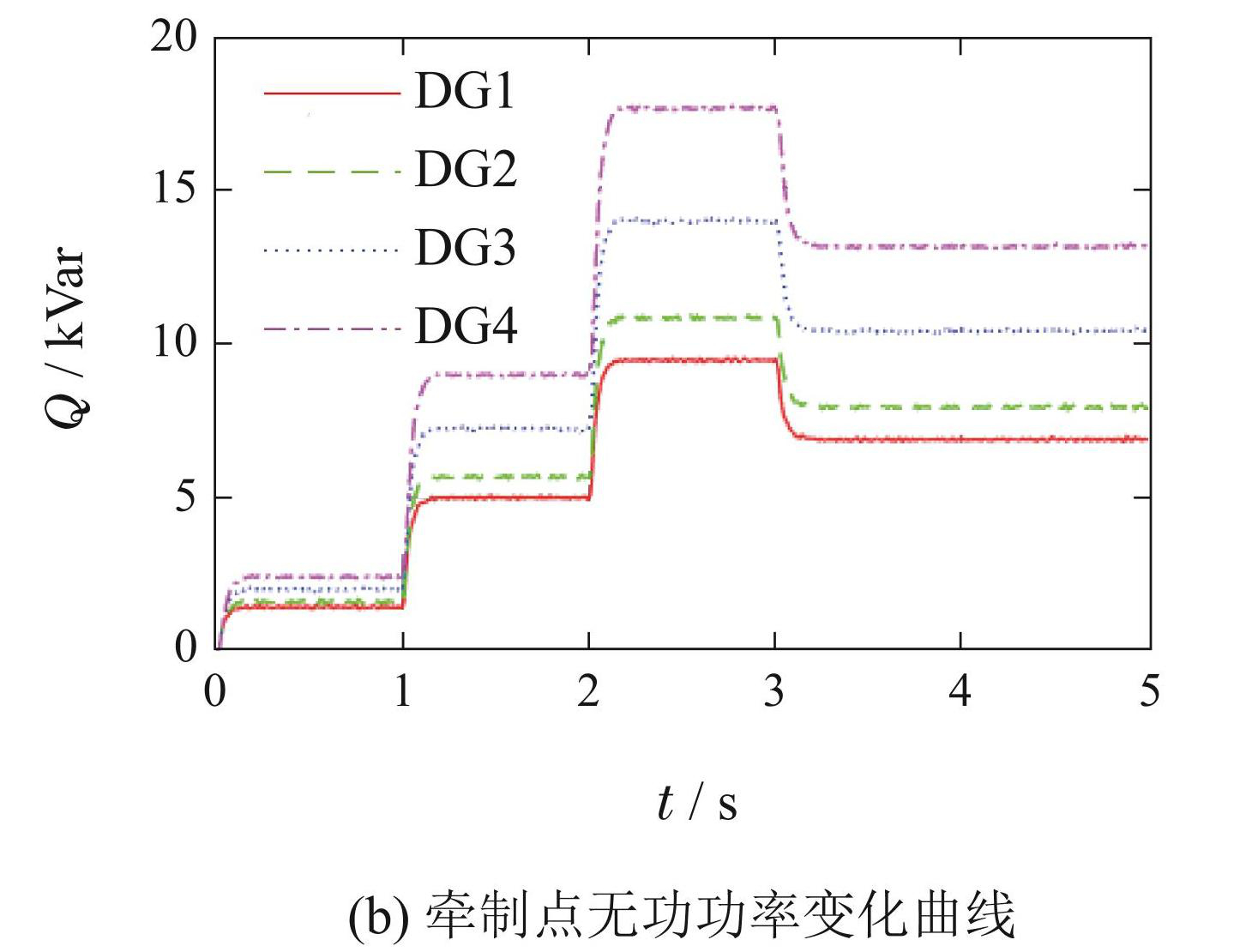

各DG具体的输出功率变化如图5所示,图6为相应的预学习阶段二次控制指令,各DG的二次控制指令能够实时跟随实际负载的变化,从而抑制频率和电压的偏差,图7为二次控制指令下的微电网频率和电压变化曲线.

图5预学习阶段输出功率变化曲线

Fig.5Output power during pre-learning stage

图6预学习阶段二次控制指令变化曲线

Fig.6Secondary control instructions in the pre-learning stage

图7预学习阶段频率电压响应曲线

Fig.7Frequency voltage response in the pre-learning stage

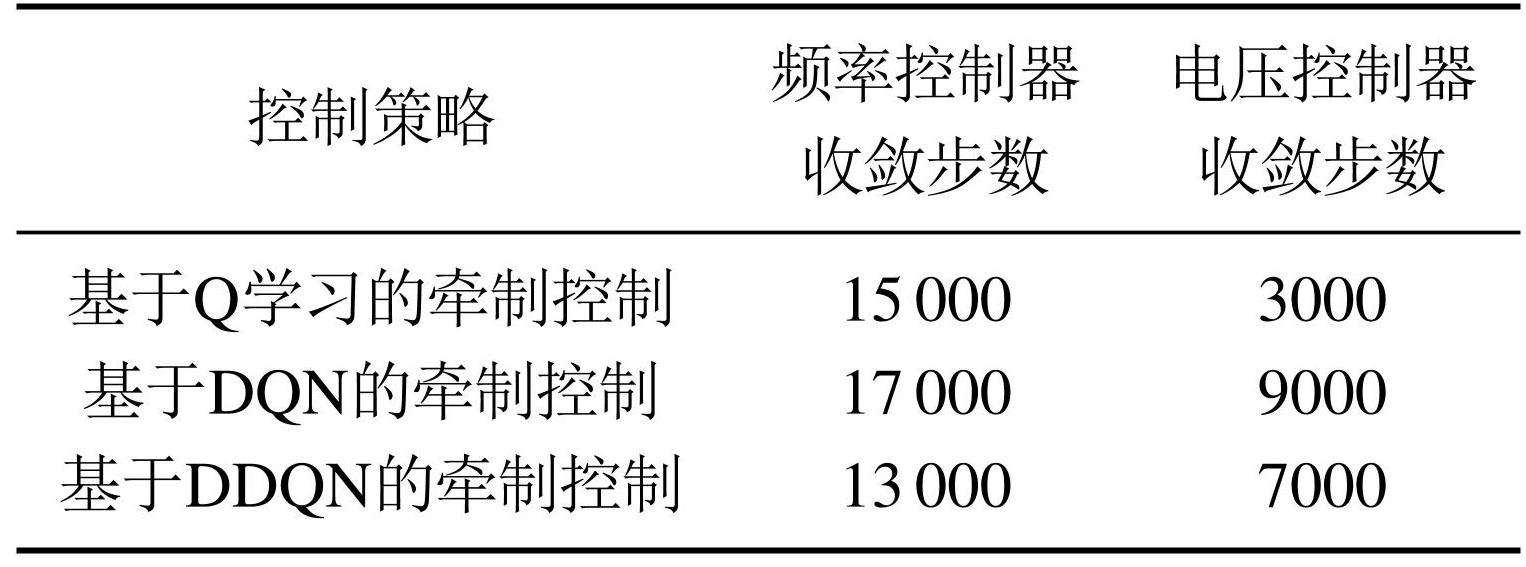

通过图7及相关数据得出,频率控制器经过13 000 步的预学习后,各DG能够将频率波动维持在(−0.02,0.02)Hz内,奖励值为0; 同时,电压控制器经过7000 步的预学习后,牵制点电压维持在(−0.01,0.01)Hz 内,奖励值也为 0. 并且当负荷增大后,仍能基本保持稳定. 进一步说明了所提的控制策略得出的动作值能够紧跟负载变化,从而提高系统频率和电压的稳定性.

不同控制策略下的收敛步数对比如表2所示,对比可知,在面对较复杂的频率控制时,DDQN在学习速度和学习效率上的优势更加明显,而对于较简单的电压控制,Q学习通过直接存储Q值表进行更新,以最少的步数达到了收敛.

表2不同控制策略下的收敛步数对比

Table2Comparison of convergence steps under different control strategies

4.2 孤立微电网负载扰动

为了验证所提控制策略在实际应用中的可行性,假设初始时刻电网发生故障,公共连接点处断路器断开,微电网由并网运行模式转为孤网运行模式,在 t = 1 s时,在A2,A3,A4,A7,A8引入负载扰动,共计有功负荷35 kW,无功负荷20 kvar. 在t = 2 s时,在A3,A4引入负载扰动,共计有功负荷 28 kW,无功负荷 24 kvar. 在t = 3 s时,切除A3处部分负荷,共计有功负荷14 kW,无功负荷12 kvar. 在该场景下仿真得出详细的各DG输出功率变化曲线如图8所示.

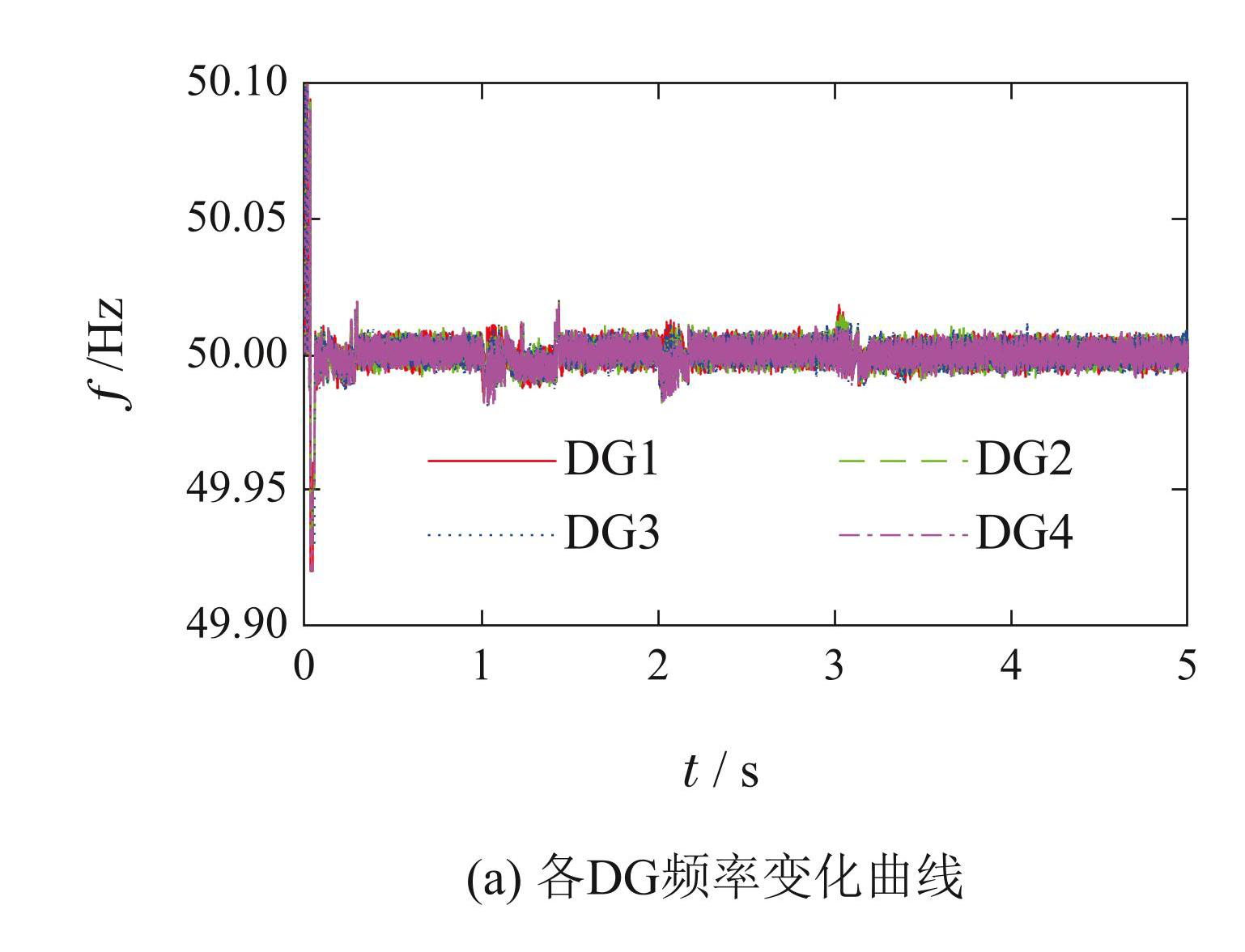

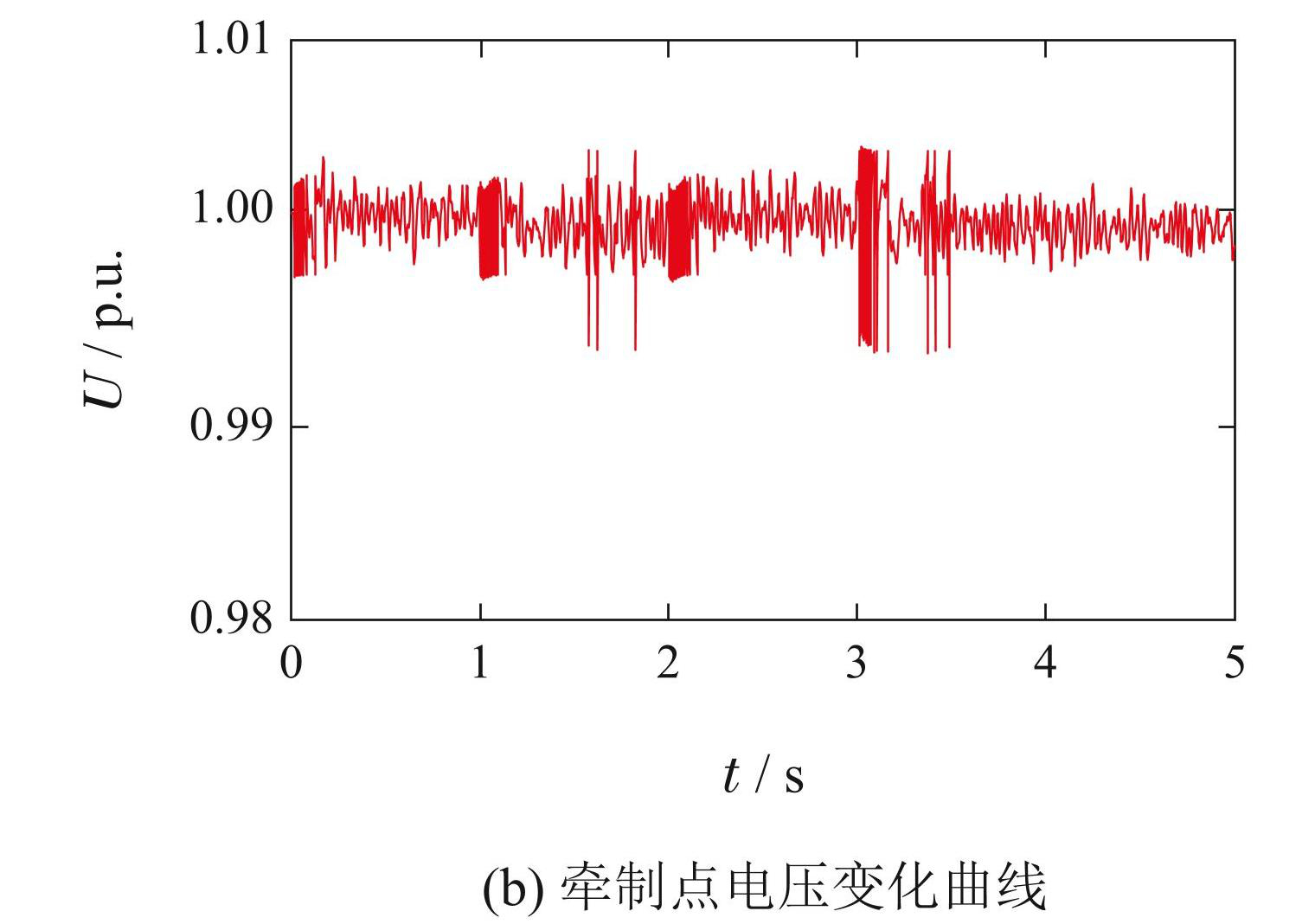

牵制控制器得出对应的频率和电压响应曲线如图9所示,基于强化学习的牵制控制器得出对应的频率和电压响应曲线如图10所示,基于DDQN的牵制控制器得出对应的频率和电压响应曲线如图11所示.

图8输出功率变化曲线

Fig.8Output power

图9牵制控制器频率电压响应曲线

Fig.9Pinning controller frequency voltage response

图10基于强化学习的牵制控制器频率电压响应曲线

Fig.10Frequency and voltage response of pinning controller based on reinforcement learning

图11基于DDQN的牵制控制器频率电压响应曲线

Fig.11DDQN based frequency and voltage response of pinning controller

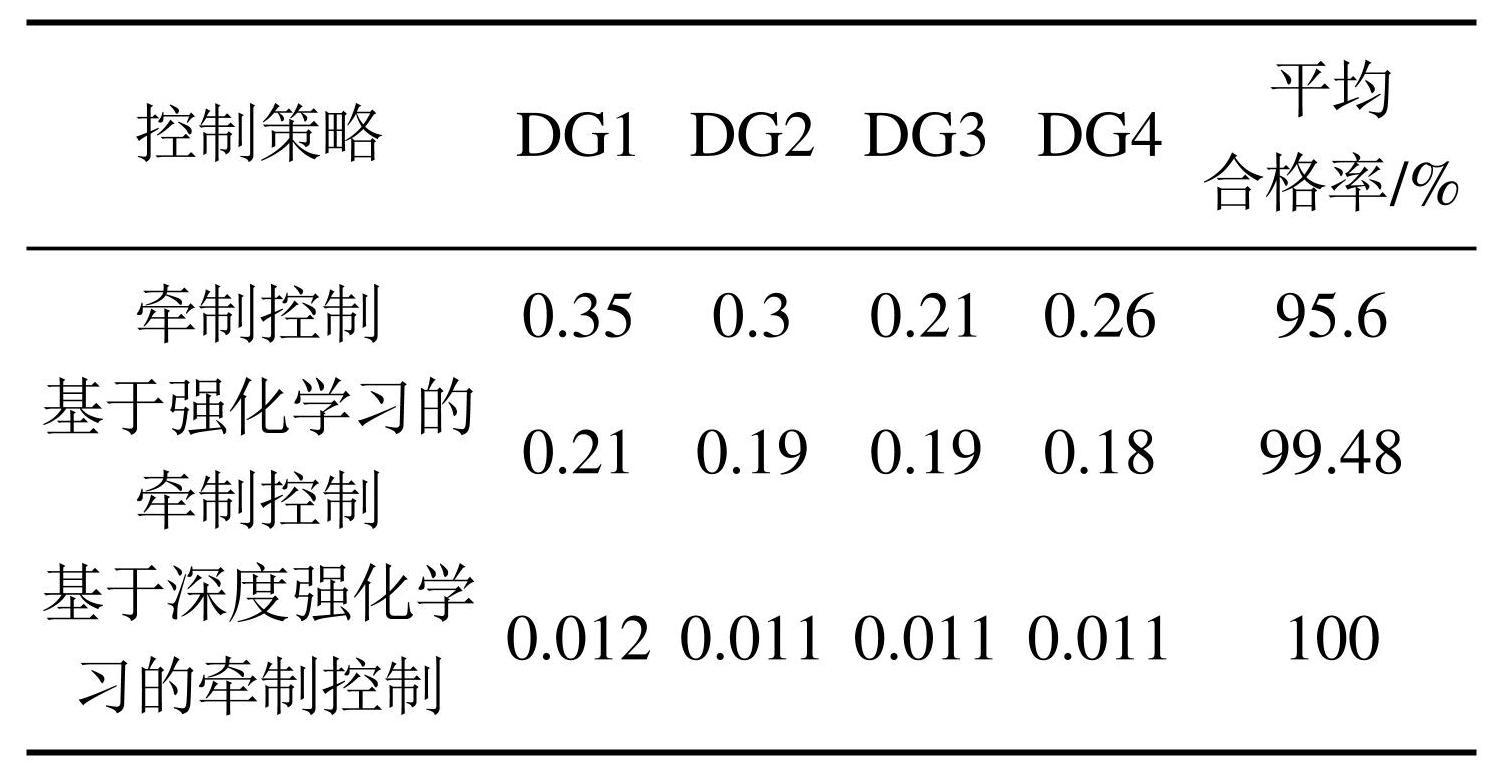

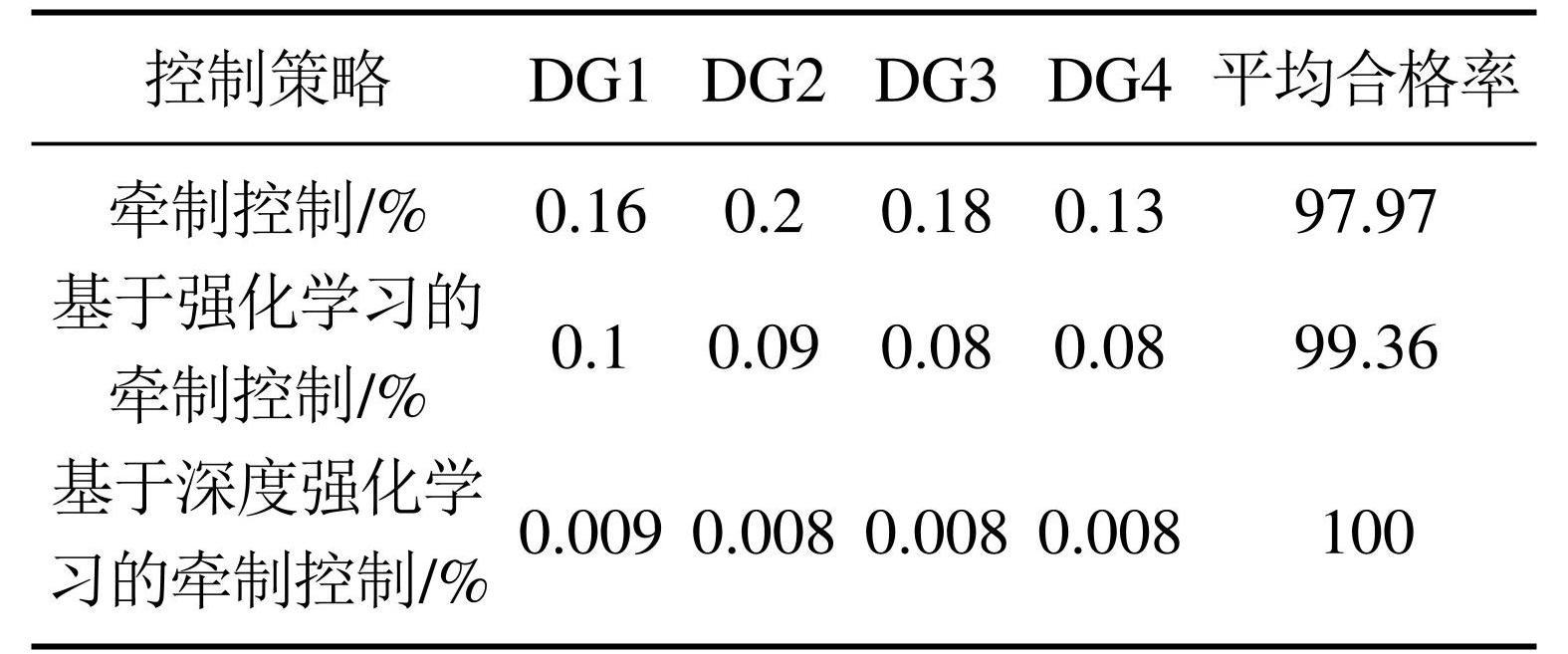

基于仿真结果及相关数据,计算在不同控制策略下各DG的频率波动率及4个DG的频率平均合格率,结果如表3所示.

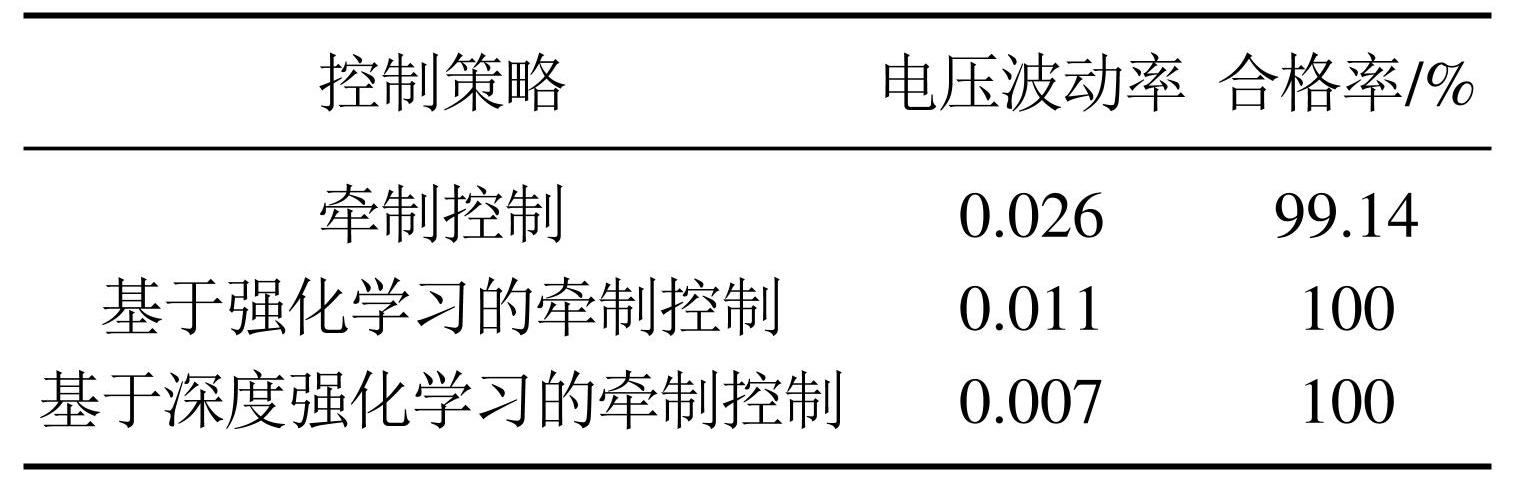

计算不同控制策略下的主牵制点电压波动率及合格率,对比结果如表4所示.

由上述分析可知,相比于牵制控制和基于强化学习的牵制控制,基于深度强化学习的牵制控制具有更低的频率波动率和电压波动率,并且频率平均合格率和电压合格率为100%,在负载扰动时能够使各个分布式发电源具有更好的频率电压稳定性.

表3不同控制策略下频率波动率及平均合格率对比

Table3Comparison of frequency volatility and average qualification rate under different control

表4不同控制策略下主牵制点电压波动率及合格率对比

Table4Comparison of voltage volatility and average qualification rate under different control

4.3 分布式电源退出运行

为了验证基于深度强化学习的分布式牵制协同控制策略对于系统通信拓扑结构变化的适应性,将DG4 在t = 2 s时切除,通信结构变化如图12所示.

图12通信结构变化示意图

Fig.12Changes in communication structure

当DG4退出运行后,与DG4所指代的A5节点相邻的A4和A6节点更新牵制控制矩阵WP的系数,同时牵制控制矩阵减少一个维度,在t = 2 s处DG4切除后,其他DGs增加功率输出以补偿功率缺额此时研究各 DG出力变化曲线如图13所示.

牵制控制器得出对应的频率和电压响应曲线如图14所示,基于强化学习的牵制控制器得出对应的频率和电压响应曲线如图15所示,基于DDQN的牵制控制器得出对应的频率和电压响应曲线如图16所示.

图13输出功率变化曲线

Fig.13Output power

图14牵制控制器频率电压响应曲线

Fig.14Pinning controller frequency voltage response

图15基于强化学习的牵制控制器频率电压响应曲线

Fig.15Frequency and voltage response of pinning controller based on reinforcement learning

图16基于DDQN的牵制控制器频率电压响应曲线

Fig.16DDQN based frequency and voltage response of pinning controller

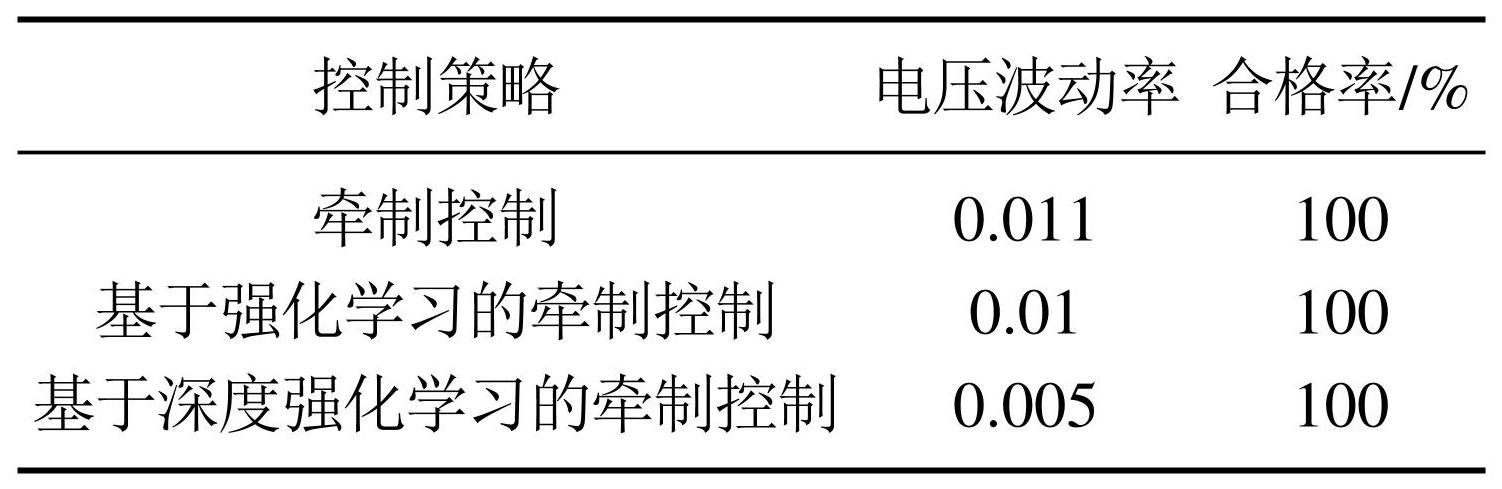

基于仿真结果及相关数据,计算得到各DG的频率波动率及3 个DG的平均合格率,如表5所示.

表5不同控制策略下频率波动率及平均合格率对比

Table5Comparison of frequency volatility and average qualification rate under different control

计算不同控制策略下的主牵制点电压波动率及合格率,如表6所示.

表6不同控制策略下主牵制点电压波动率及合格率对比

Table6Comparison of voltage volatility and average qualification rate under different control

通过比较两种场景下3种控制策略的频率和电压的波动率和合格率,基于深度强化学习的牵制控制在系统拓扑结构发生变化时频率和电压波动最低,具有良好的频率电压稳定性.

5 结论

本文旨在研究基于深度强化学习的分布式牵制协同控制策略,设计了基于深度强化学习的牵制控制器,并通过仿真验证了该方法在负载扰动和孤立微电网系统结构变化时的有效性和适应能力,得到以下结论:

1)深度强化学习能够自适应修正牵制目标值,提升了牵制一致性算法的有效性. 相比于牵制控制和基于强化学习的牵制控制方法,所提控制方法频率波动率在0.01%左右,电压波动率在0.006%左右,电压频率波动抑制方面更具优势;

2)相比于牵制控制和基于强化学习的牵制控制方法,基于深度强化学习的牵制控制策略能够在相同的神经网络下适应不同数量的分布式电源,具有适应系统结构变化的能力.